在开发日常中,你是否也曾被这些场景困扰:想试试大模型写代码,却要注册账号、绑信-用-卡、填企业信息;好不容易跑通一个 Demo,结果发现 API 调用费用高得吓人;或者公司内网根本连不上境外服务,只能眼睁睁看着别人用 AI 提效?

更麻烦的是,市面上大多数“免费”工具,要么偷偷上传你的代码,要么限制功能,要么只支持单一模型,想切换 GLM 和 GPT?没门。

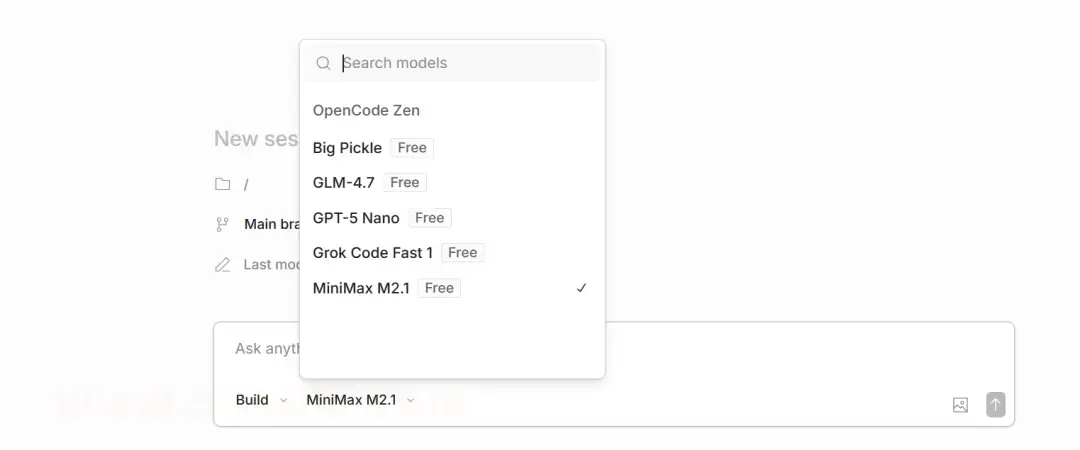

那有没有一种方式,能让你不注册、不付费、不传代码,还能自由切换 Big Pickle、GLM-4.7、GPT-5 Nano、Grok Code Fast 1、MiniMax M2.1 这些热门模型,直接在本地写代码、跑逻辑、看结果?

现在,有了。

为什么开发者需要一个“模型自由”的编程助手?

当前 AI 编程工具生态看似繁荣,实则割裂。每个平台都试图把你锁在自己的模型和账号体系里。而真实开发场景往往是混合的:今天用国产模型处理敏感逻辑,明天用国际模型生成英文注释,后天想试试 Grok 的推理速度。

但现实是,你得装五个插件、开五个网页、记五套密钥。效率没提上来,心累倒是翻倍了。

OpenCode 的出现,正是为了打破这种“模型孤岛”。它不做模型,只做桥梁,让你在一个界面里,无缝调用多个免费、开放、无需登录的大模型,且所有交互默认走本地或自定义端点,数据完全由你掌控。

介绍:三端支持,模型随心换

OpenCode 是一个开源的 AI 编码代理,提供三种使用形态:

• 终端界面(TUI):轻量快速,适合远程服务器或命令行爱好者。 • 桌面应用:支持 Windows、macOS(Intel/Apple Silicon)、Linux(.deb/.rpm/AppImage),图形化cao作更直观。 • IDE 插件:未来将支持主流编辑器,边写代码边获得 AI 建议。

关键的是,它内置一系列免费模型,也支持连接任何兼容 OpenAI 协议的 LLM 服务。

目前社区已验证以下模型可直接使用(无需账号):

• Big Pickle:专为代码理解优化,上下文窗口达 128K • GLM-4.7:国产高性能模型,中文注释生成较好 • GPT-5 Nano:轻量版 GPT-5,响应快、资源占用低 • Grok Code Fast 1:擅长算法题与系统设计 • MiniMax M2.1:平衡速度与准确率,适合日常 CRUD

这些模型可免费调用,也可通过本地推理工具(如 Ollama、LM Studio)部署后接入,全程无需登录。

技术架构:轻量、安-全、可扩展

OpenCode 前端基于 SolidJS + Tailwind CSS 构建,启动迅速、内存占用低;终端界面采用 Ghostty 渲染引擎,流畅度媲美原生终端。后端服务层使用 Hono 微框架(hono: 4.10.7),天然适配 Cloudflare Workers 等边缘环境。

项目采用 monorepo 结构,核心逻辑封装在 @opencode-ai/sdk 模块中(位于 packages/sdk/js),便于未来作为 npm 包集成到自有系统。依赖库如 ai: 5.0.119、zod、remeda 等均为现代、类型安-全的方案。

所有模型请求均由用户确认端点发起。若连接本地 LLM(如 Ollama 启动的 GLM-4.7),通信完全在本机完成,代码与上下文不会外传。网站明确声明:OpenCode 不会存储你的任何代码或上下文数据,适合对隐私敏感的开发场景。

部署方式:三分钟上手,零成-本运行

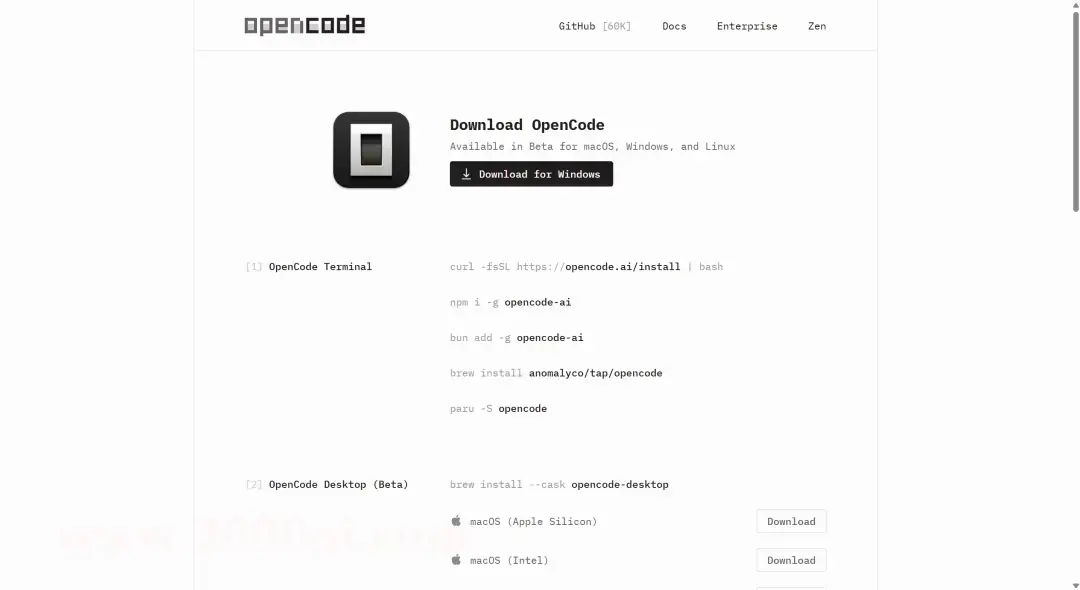

简单的体验方式是使用桌面版,支持全平台一键安装。

也可以通过多种方式全局安装终端版:

# 通用安装脚本

curl -fsSL https://opencode.ai/install | bash

# 或使用包管理器

npm i -g opencode-ai@latest

brew install opencode # macOS/Linux

scoop install extras/opencode # Windows

choco install opencode # Windows

paru -S opencode-bin # Arch Linux

终端用户还可通过 Docker 快速运行:

docker run -it --rm ghcr.io/anomalyco/opencode注意:桌面版为独立 Electron 应用,无需端口映射;Docker 方式仅适用于终端版。

对于希望深度集成的团队,项目已预留 SDK 接口,未来可作为 npm 包嵌入内部工具链。

开源协议:MIT 授权,商用无顾虑

OpenCode 采用 MIT 开源协议,允许自由使用、修改和分发,包括用于商业产品。你不需要公开你的衍生代码,也不需要向原作者支付任何费用。

唯一提醒:如果你通过 OpenCode 连接第三方模型服务(如 OpenAI、Anthropic),请遵守其使用条款。但 OpenCode 本身不绑定任何厂商,核心功能完全独立运行。

即刻体验一波

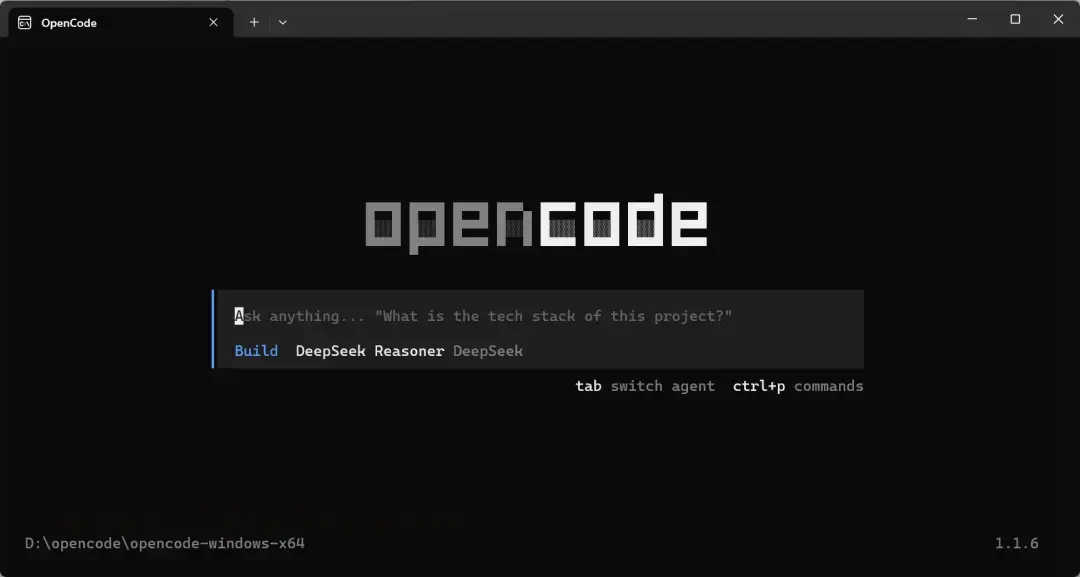

以 Windows 桌面版为例,安装过程极其简单:下载安装包 → 点击 Next → 启动即可。首次打开时,系统会自动加载内置的免费模型,无需登录、无需配置。

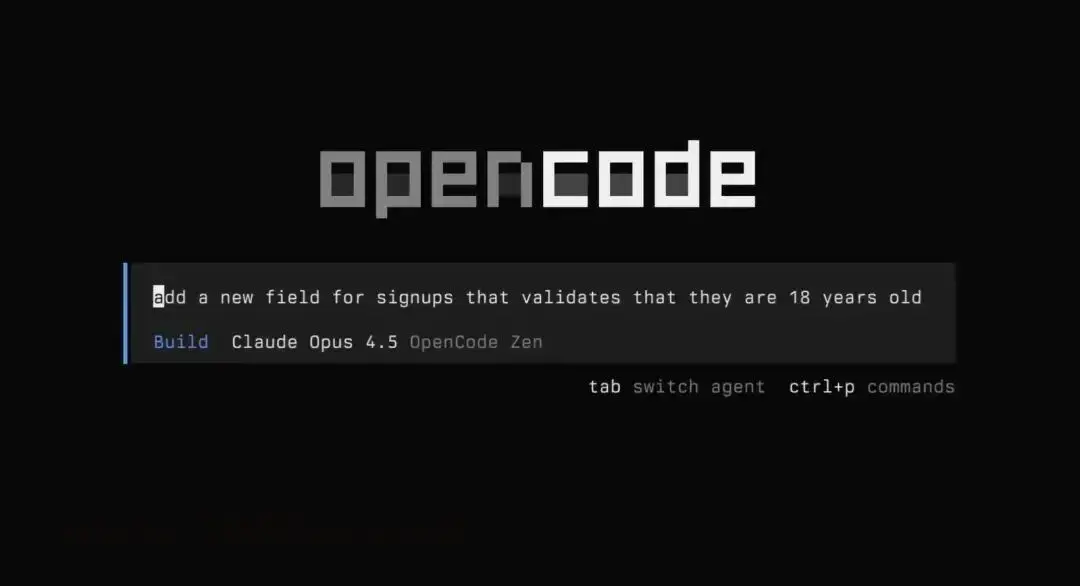

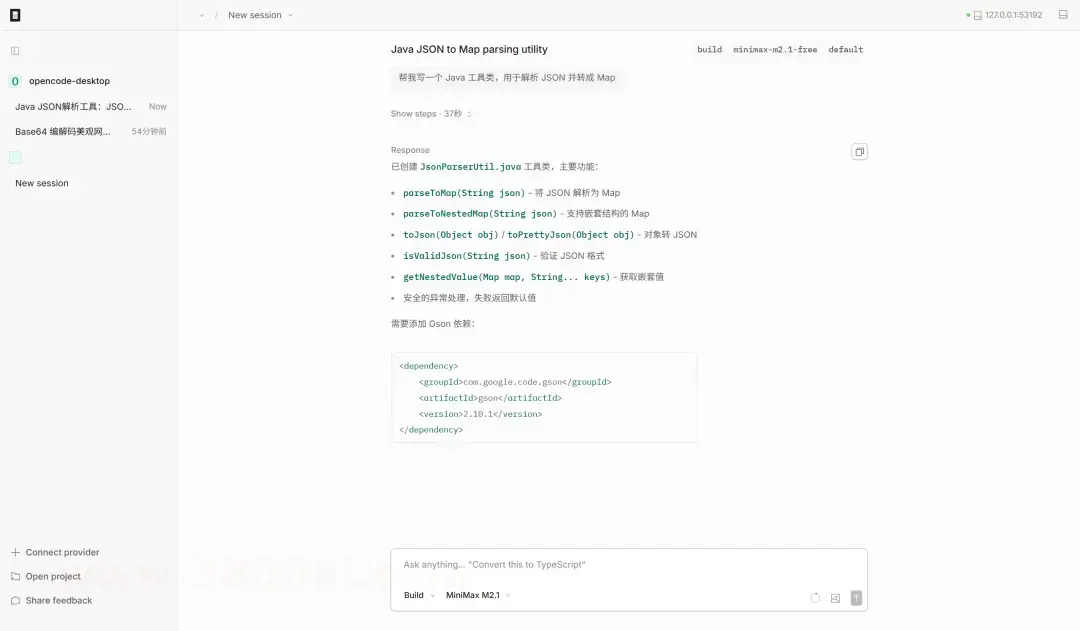

你可以在聊天窗口中输入自然语言指令,比如:

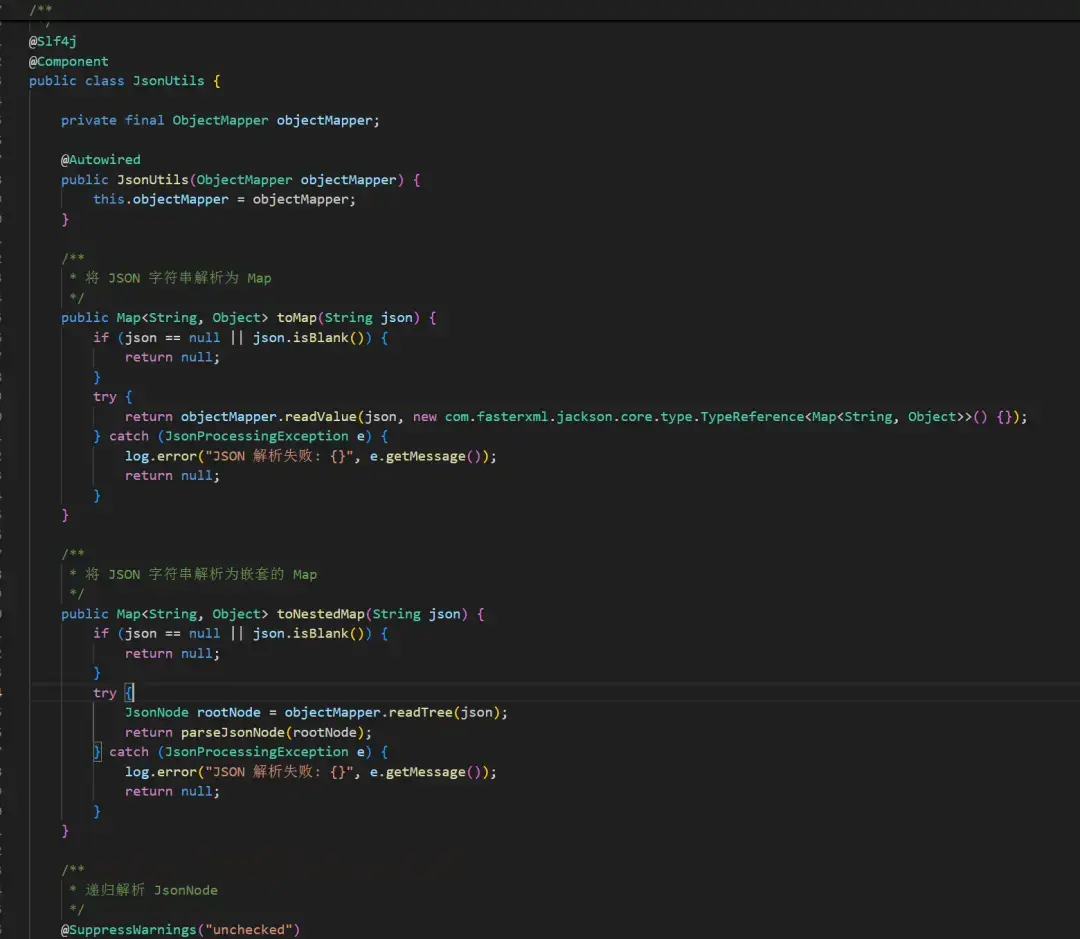

“帮我写一个 Java 工具类,用于解析 JSON 并转成 Map”

AI 会生成完整代码,并支持一键插入当前文件。更妙的是,它还能理解项目上下文,如果你正在编辑一个 Spring Boot 项目,它会自动采用符合该框架风格的写法。

此外,OpenCode 支持多会话并行、会话链接分享、LSP(语言服务器协议)自动加载等功能,极大提升了协作与调试效率。

业务场景:多模型协同,覆盖全开发周期

• 需求澄清:用 GLM-4.7 理解中文产品文档,生成技术要点。 • 核心逻辑编写:调用 Big Pickle 处理复杂算法。 • 单元测试生成:Grok Code Fast 1 快速产出边界 case。 • 性能优化建议:MiniMax M2.1 分析热点代码。 • 跨语言迁移:GPT-5 Nano 将 Python 脚本转为 Java 服务。

尤其适合中小型团队,没有专职 AI 工程师,但又想利用现有开源模型能力。

结语

真正的生产力工具,不该让你在注册页面浪费时间,也不该用“免费”当诱饵再悄悄收费。OpenCode 的价值,不在于它自己有多强,而在于它把选择权交还给开发者:用什么模型、在哪运行、是否联网,全部由你说了算。

评论区