最近有小伙伴在咨询如何在飞牛Docker上部署OpenClaw……嗯……OpenClaw对于小白用户来说难度有点大,咱们可以使用平替:CoPaw。OpenClaw和CoPaw是什么?两者的区别是什么?OpenClaw 和 CoPaw 都是 Agentscope 生态下的工具,核心定位都是为 AI Agent 应用提供运行时环境 / 交互界面。CoPaw:一个开箱即用的“AI Agent应用商店+运行沙箱”,普通用户无需写代码就能直接使用现成的AI Agent应用,开发者也能快速部署自己的Agent到平台上。可视化界面、低代码 / 无代码、聚焦 “使用” 和 “快速部署”。OpenClaw:一套用于开发AI Agent的核心工具包或运行引擎,是CoPaw的 “底层技术底座”,开发者可以基于它定制化开发自己的AI Agent逻辑,灵活性更高。代码级定制、模块化设计、聚焦 “开发” 和 “定制化”。

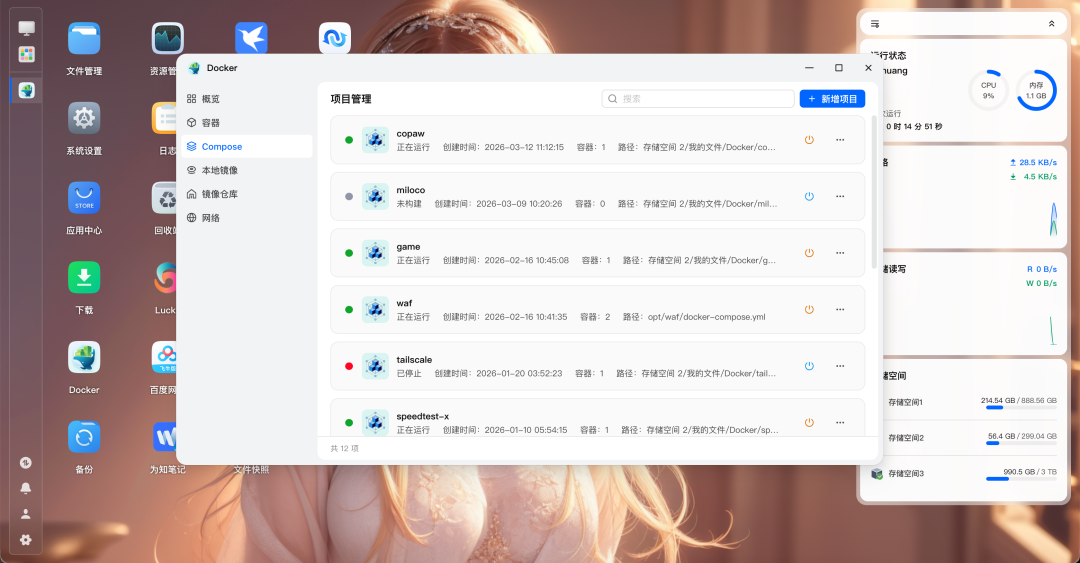

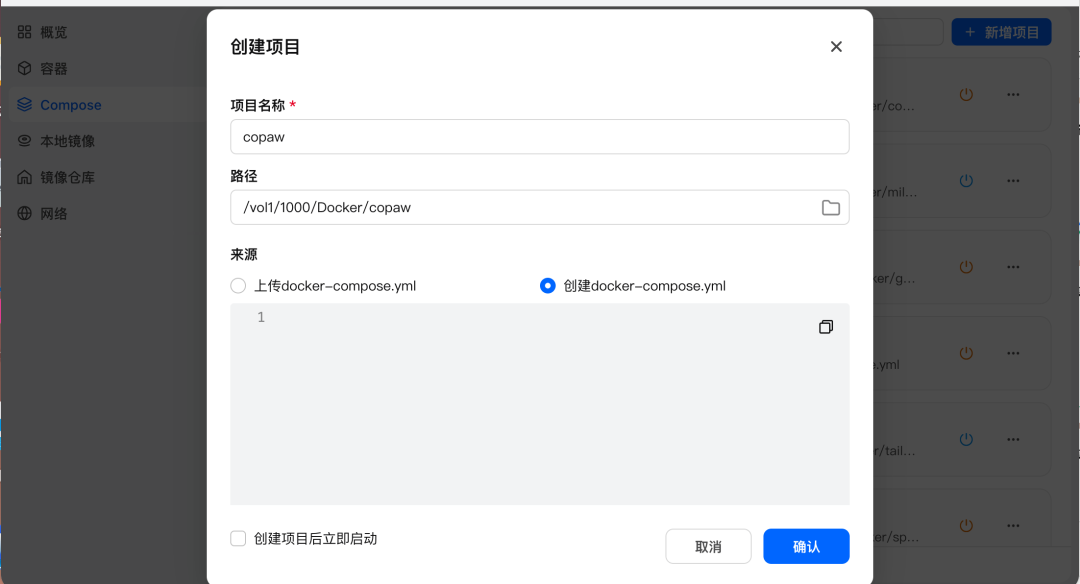

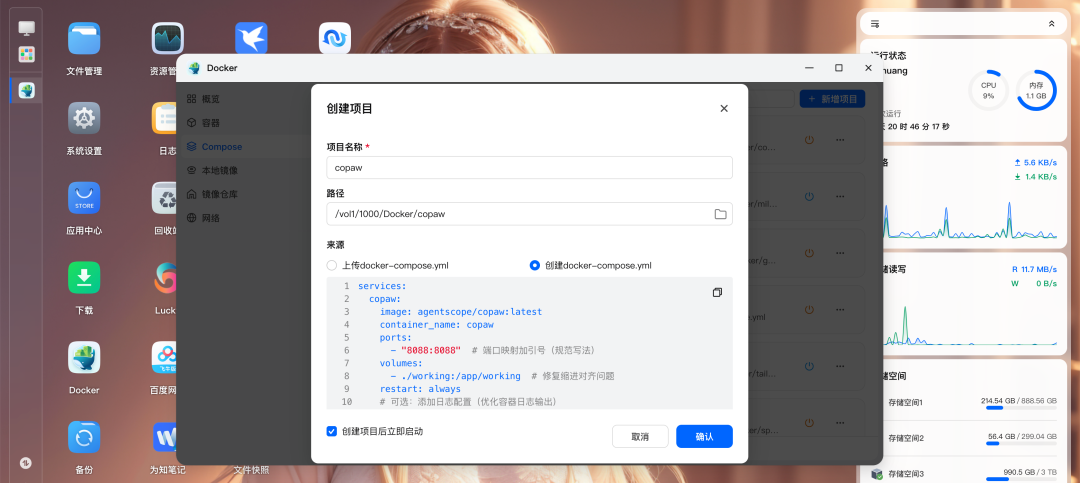

简单来说,想快速用/部署Agent选CoPaw,想定制化开发Agent核心逻辑选OpenClaw。本教程是把CoPaw部署到Docker上,对于很多需要权限的功能基本上都用不上,只能用于体验哦!部署在Docker上的好处是解决环境一致性、简化部署流程、提升运维效率,且资源隔离与安全,避免影响主机、其他应用、用户数据隐私。打开飞牛NAS,进入【Docker】应用-【Compose】-【新建项目】项目名称填写【copaw】,设置一下存储路径,点击【创建docker-compose.yml】复制下面内容(如果复制出问题,可以关注本公众号,在公众号后台回复【copaw】获取】),粘贴到内容框里。services:

copaw:

image: agentscope/copaw:latest

container_name: copaw

ports:

- "8088:8088" # 端口映射加引号(规范写法)

volumes:

- ./working:/app/working # 修复缩进对齐问题

restart: always

# 可选:添加日志配置(优化容器日志输出)

logging:

driver: "json-file"

options:

max-size: "10m"

max-file: "3"

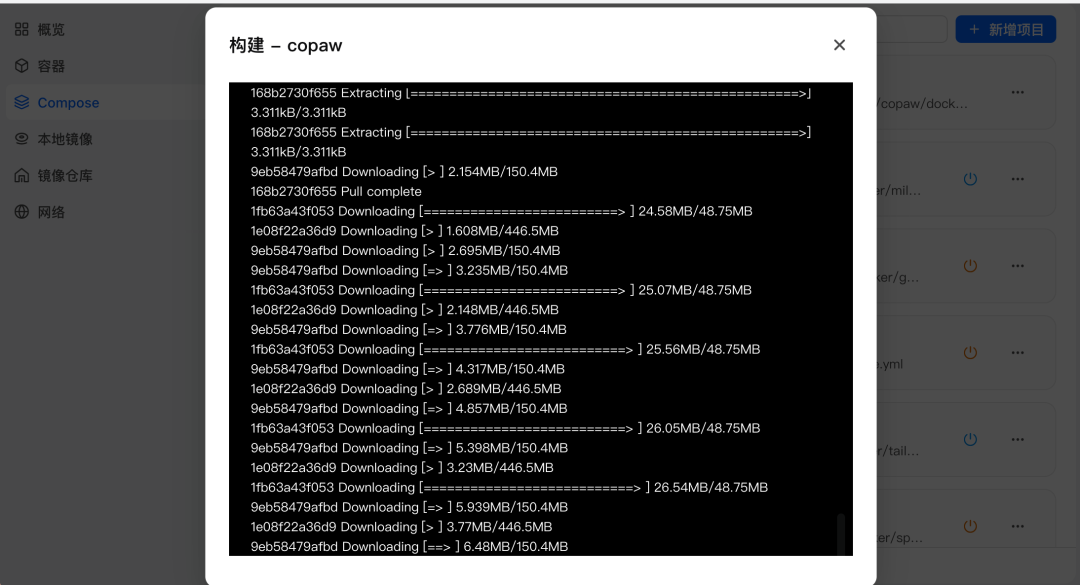

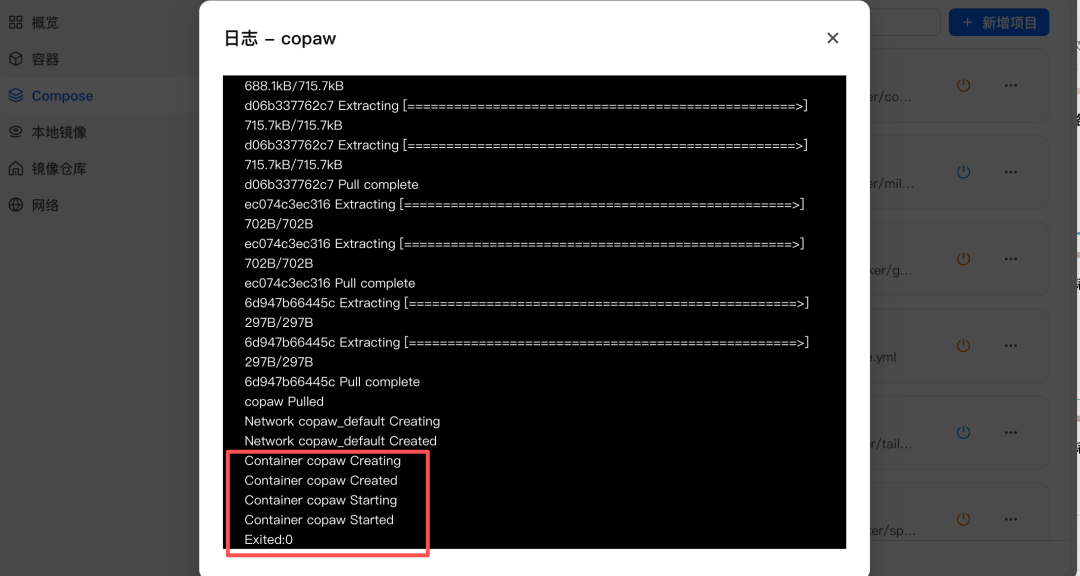

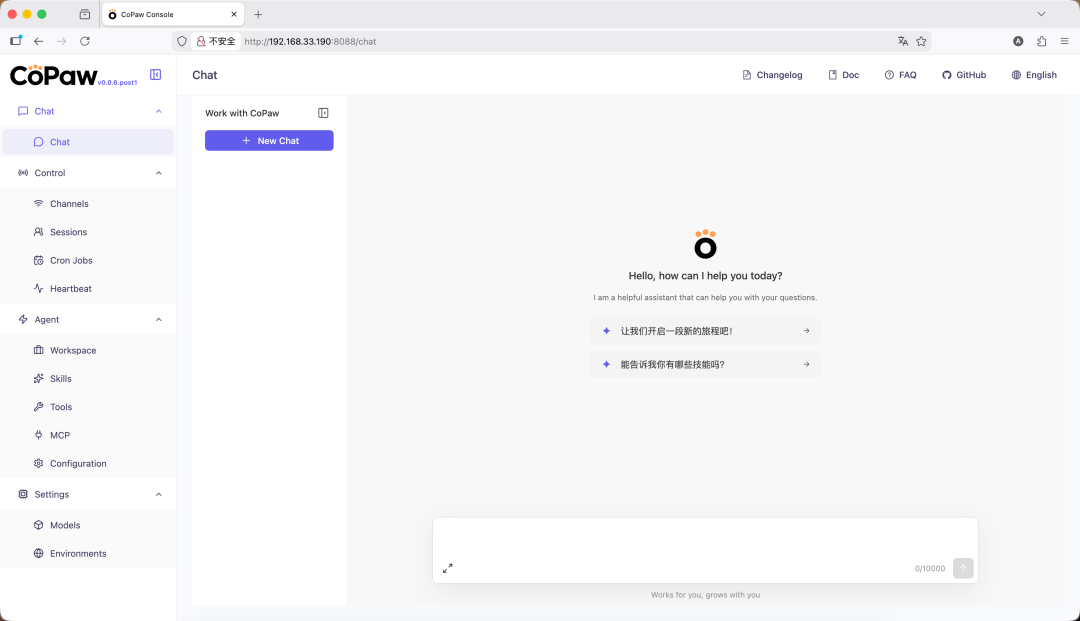

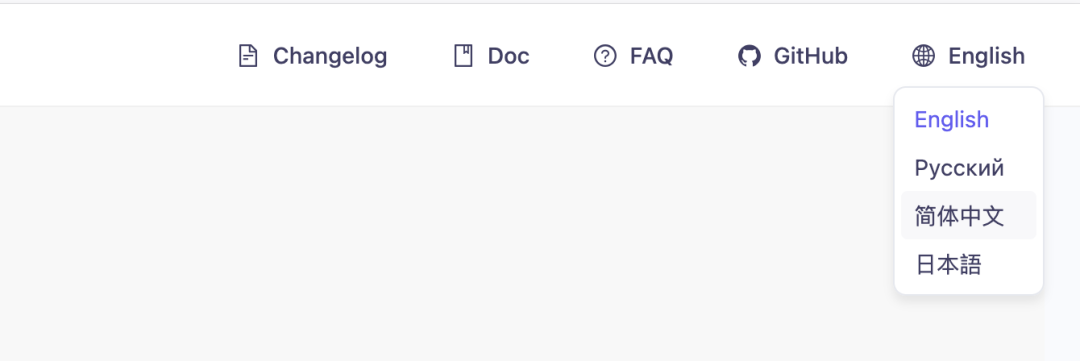

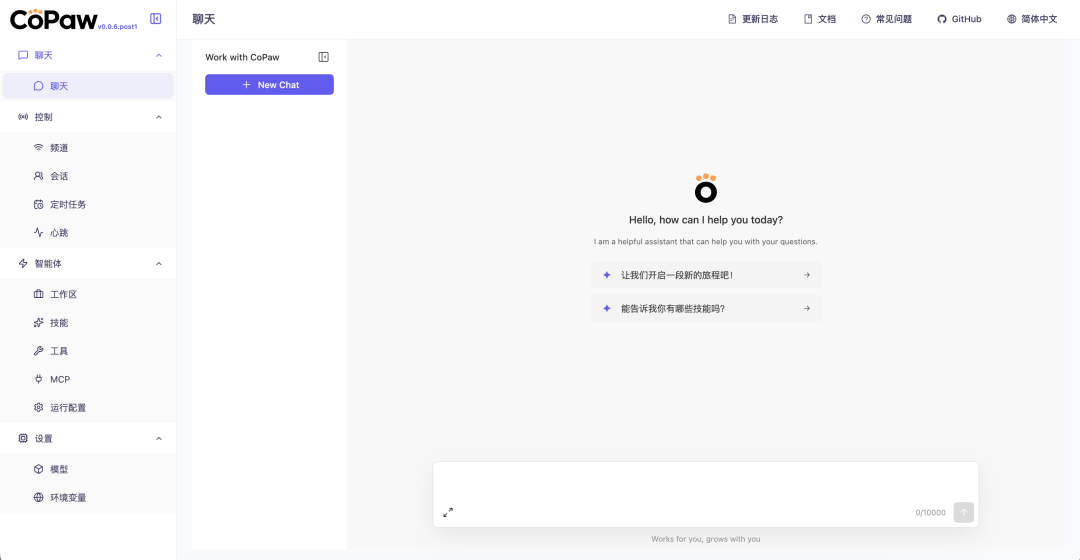

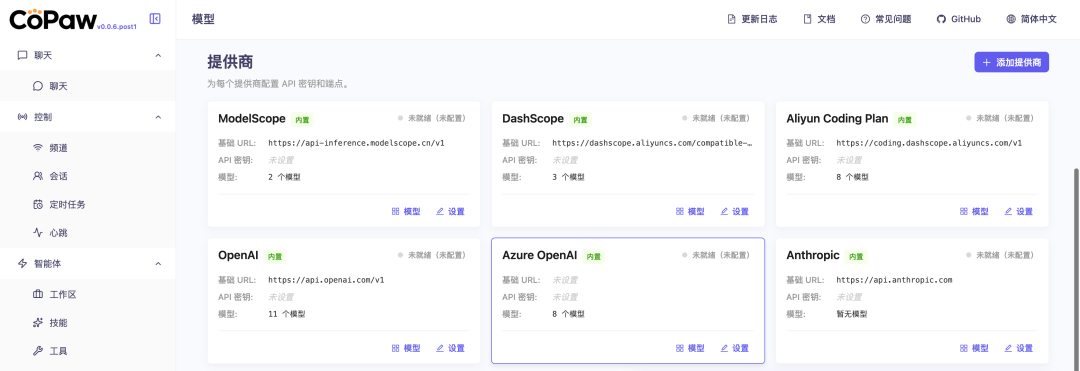

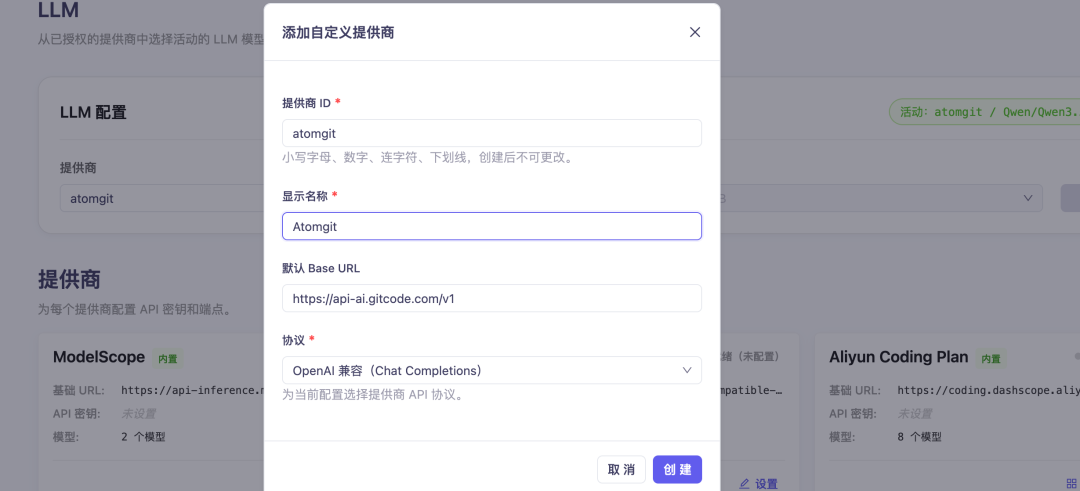

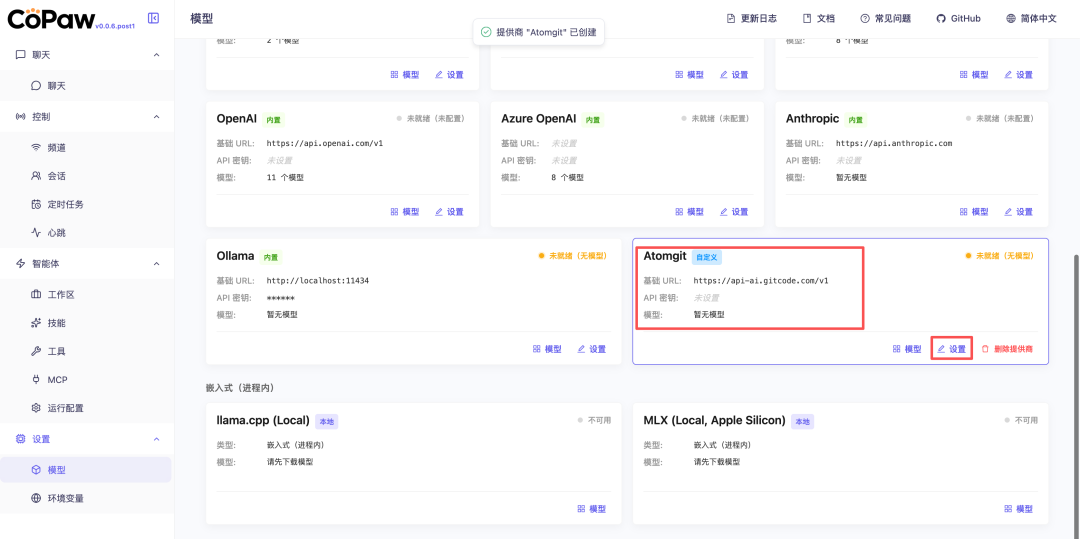

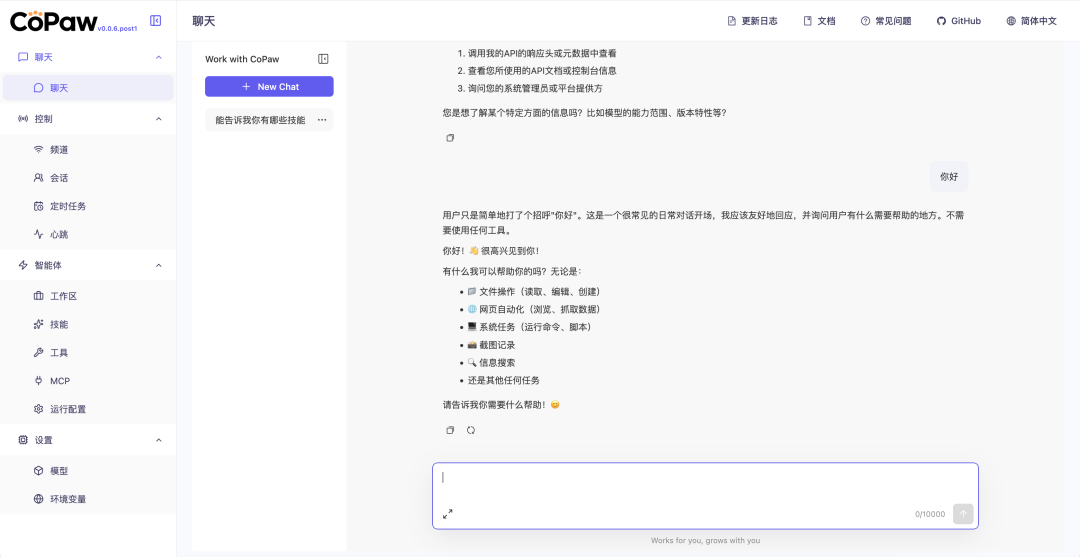

勾选【创建项目后立即启动】,点击【确认】,就会自动开始拉取了。等待一会儿……出现【Container copaw Started】和【Exited:0】就成功了。部署完成之后,打开浏览器访问【飞牛IP:8088】,就能看到这个界面。首次进入CoPaw的界面是英文的,咱们需要把它改为中文。这样就顺眼多了,但是还没有配置LLM(提供商和大模型),所以暂时用不了。点击左下角的【模型】就能看到许许多多的卡片,这里你可以选择任意一家,也可以自己添加提供商。(小白这里使用【添加提供商】)这个界面就是自定义提供商的,小白这里使用的是Atomgit提供的模型,需要添加一个接口。如果你是跟小白用一用的提供商,则可以完全按照小白的设置方式。提供商ID:atomgit

默认Base URL:https://api-ai.gitcode.com/v1

协议:OpenAI兼容(Chat Completions)

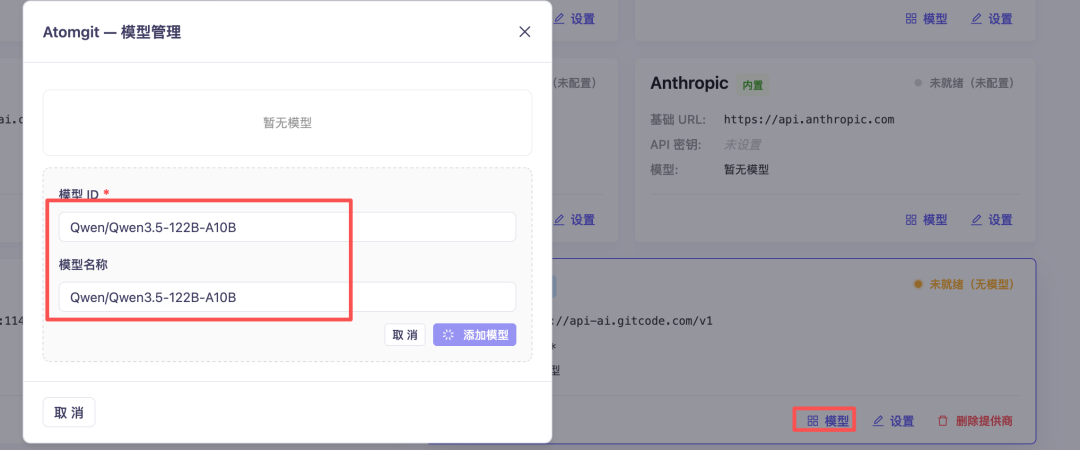

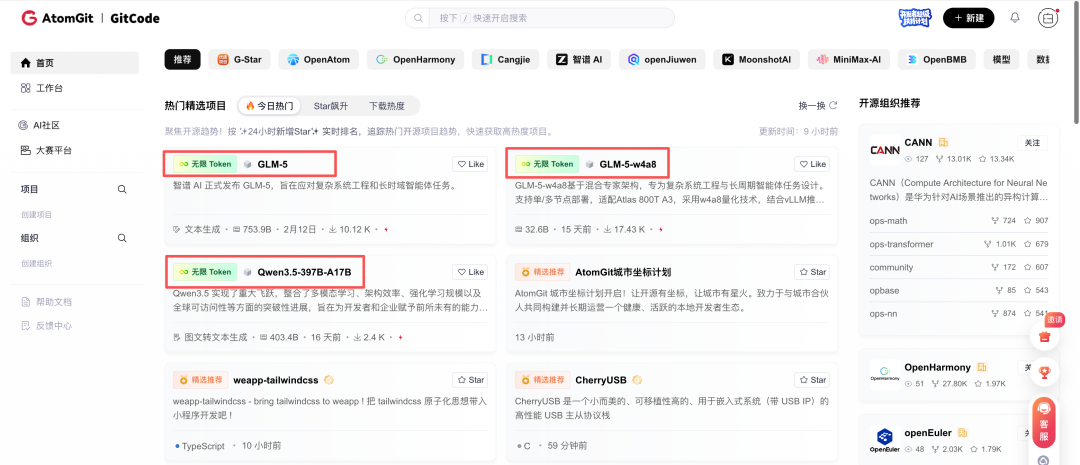

(非广告)atomgit.com的模型,注册送200万tokens,但是有别的活动可以白piáo:免费不限量。(注册教程在下一节内容)确认没问题之后点击【创建】,接着在下面的卡片就能看到自定义的提供商。点击卡片上的【设置】填写好API密钥(密钥在【05 获取Atomgit的api key】有获取教程),接着点击【保存】再点击卡片上的【模型】,填写模型的ID,这里可选的有很多,但如果跟小白一样,则可以用下面这些:添加完成之后点击【测试链接】上面会提示【Connection successful】最后滑动到顶部,【LLM配置】里选择一下刚刚设置的【提供商】和【模型】,点击【保存】,右上角出现【活动:模型名称】就成功了。Atomgit目前有无限的token活动,适用模型:调用地址统一是:

https://api-ai.gitcode.com/v1

API Key去这里领:

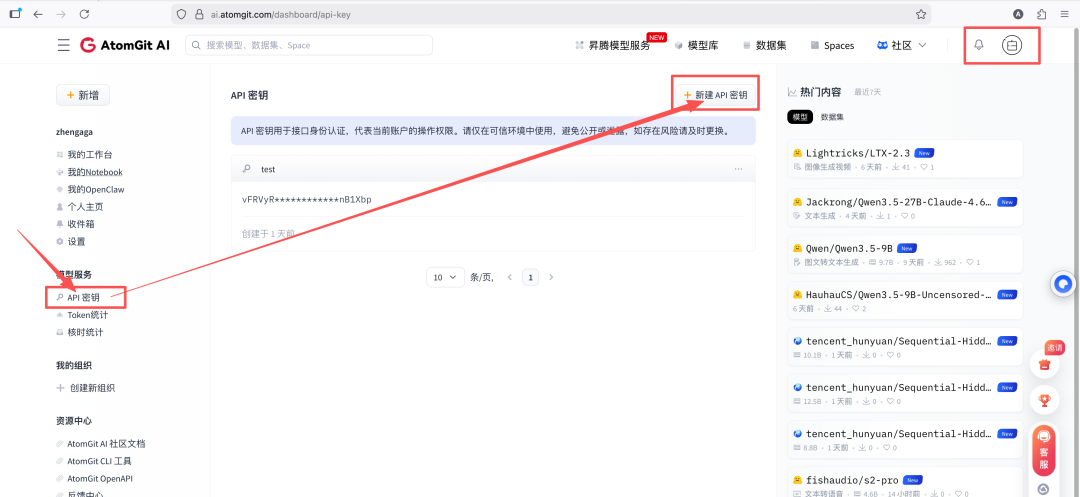

https://ai.atomgit.com/dashboard/api-key

这就是一套完全兼容OpenAI格式的接口。

打开API Key的领取页面,注册登录一下,然后点击页面左边的【API 密钥】,点击【新建 API 密钥】

注意要手动保存一下,好像只能显示一次!

剩下的就是折腾的乐趣了……哈哈哈……其实如果不直接部署在宿主机上,感觉就跟玩豆包没啥区别。

评论区