OpenClaw Token 自由!本地模型搭建完整教程,4 月最新版

想要 Token 自由吗?想要本地运行 AI 模型吗?本教程从零开始,手把手教你使用 OpenClaw 搭配 llama.cpp,快速搭建本地 AI 模型,实现 Token 自由!全程详细步骤,小白也能轻松上手!

🦞 什么是 OpenClaw?

OpenClaw(中文名:小龙虾)是一个功能强大的开源 AI 助手框架,由国内开发者社区维护。它最大的特点就是支持本地模型部署,让你不再受限于 API 调用限制和高昂的 Token 费用。

核心优势

- ✅ Token 自由:本地运行模型,无需担心 Token 限制

- ✅ 数据隐私:所有数据都在本地处理,完全掌控

- ✅ 多平台接入:支持微信、飞书、钉钉等多个平台

- ✅ 完全免费:开源免费,无任何隐藏费用

- ✅ 灵活扩展:支持自定义技能和工作流

适用场景

- 个人开发者:学习 AI 技术,搭建个人助手

- 小微企业:低成本部署客服系统

- 教育机构:教学演示和实验环境

- 研究机构:模型测试和对比实验

🛠️ 准备工作

在开始之前,我们需要做好充分的准备工作。这一步很重要,准备充分可以避免后续很多麻烦。

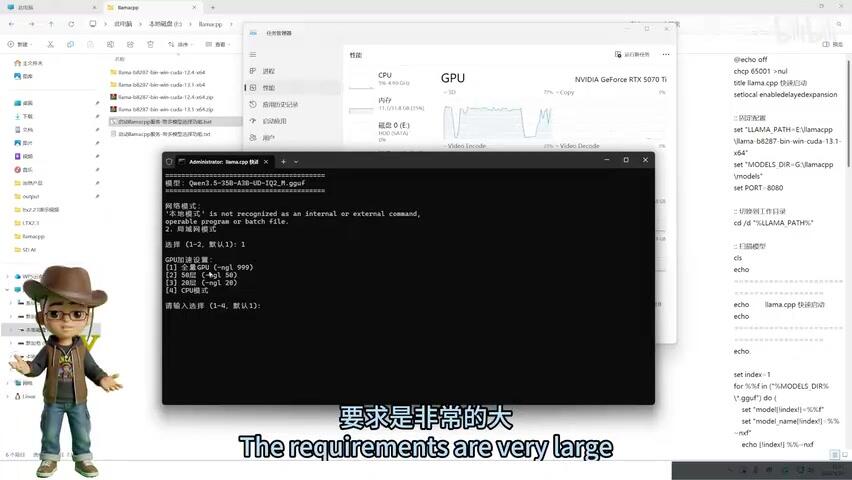

硬件要求

| 配置项 | 最低要求 | 推荐配置 | 说明 |

|---|---|---|---|

| CPU | 4 核 | 8 核以上 | 影响推理速度 |

| 内存 | 4GB | 8GB 以上 | 影响模型加载 |

| 磁盘 | 10GB | 20GB 以上 | 存储模型和依赖 |

| 网络 | 稳定连接 | 高速宽带 | 下载依赖和模型 |

软件环境

- 操作系统:Windows 10/11、macOS 10.15+、Linux(Ubuntu 20.04+)

- Python 版本:3.8 或更高(推荐 3.10)

- Git:用于代码克隆和版本管理

- 包管理器:pip(Python 包管理)

获取项目

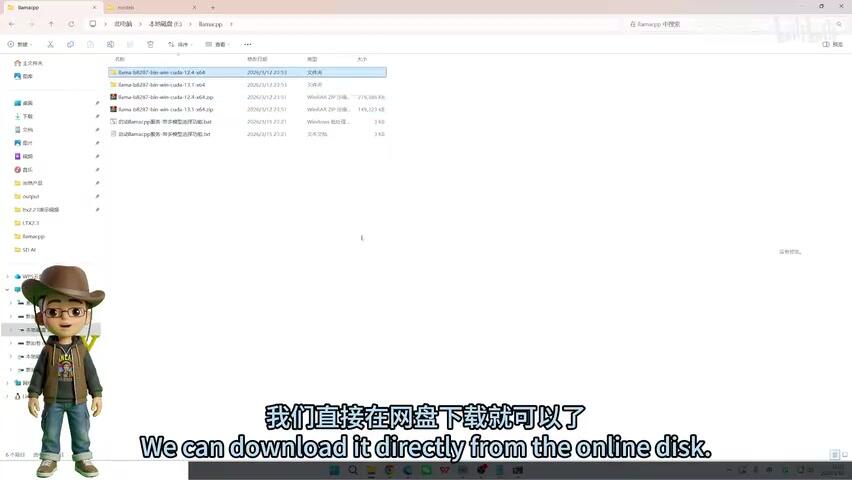

OpenClaw 提供了完整的整合包,通过夸克网盘下载:

- 网盘链接:https://pan.quark.cn/s/2adc14f141cd

- 提取码:AwhD

- 文件大小:约 2GB

- 包含内容:完整项目代码、依赖包、示例配置

下载说明: 1. 打开夸克网盘链接 2. 输入提取码 AwhD 3. 点击"保存到网盘"或直接下载 4. 下载完成后解压到本地目录

📥 步骤 1:获取项目文件

方式一:网盘下载(推荐新手)

网盘下载是最简单的方式,适合不熟悉 Git 的用户。

详细步骤:

-

注册夸克账号 - 访问 https://pan.quark.cn/ - 使用手机号注册 - 新用户有免费空间

-

下载项目 - 打开链接:https://pan.quark.cn/s/2adc14f141cd - 输入提取码:AwhD - 点击"转存"到自己的网盘 - 选择"下载"到本地

-

解压文件 - 找到下载的压缩包 - 右键选择"解压到当前文件夹" - 等待解压完成

方式二:Git 克隆(推荐开发者)

如果你熟悉 Git,可以直接从 GitHub 克隆最新代码。

详细步骤:

# 1. 打开终端(Windows 使用 PowerShell 或 CMD)

# 2. 选择项目目录

cd /path/to/your/workspace

# 3. 克隆项目

git clone https://github.com/openclaw/openclaw.git

# 4. 进入项目目录

cd openclaw

# 5. 查看项目结构

ls -la

项目目录说明:

openclaw/

├── main.py # 主程序入口文件

├── config/ # 配置文件目录

│ ├── settings.py # 基础配置

│ └── models.py # 模型配置

├── skills/ # 技能扩展目录

│ ├── weather.py # 天气查询技能

│ └── calculator.py # 计算器技能

├── docs/ # 文档目录

├── requirements.txt # Python 依赖列表

└── README.md # 项目说明文档

⚙️ 步骤 2:配置环境

创建虚拟环境

为什么要用虚拟环境? - 避免污染系统 Python 环境 - 不同项目可以有不同的依赖版本 - 方便管理和迁移

Windows 系统:

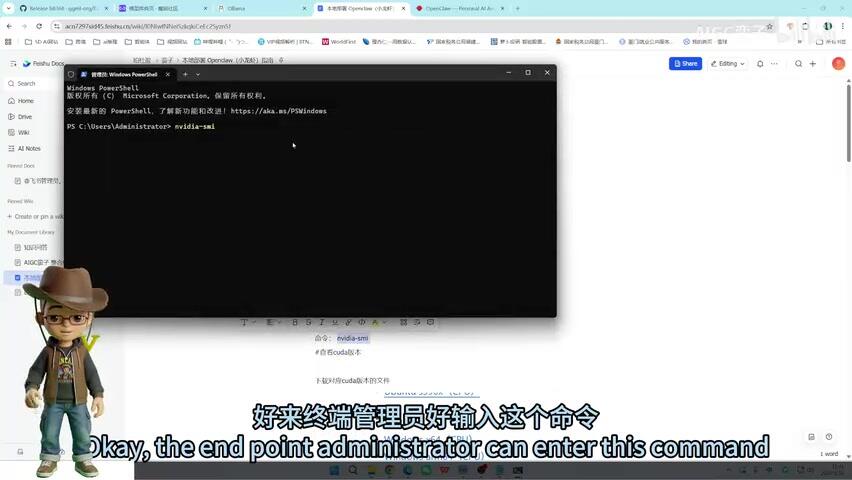

# 1. 打开 PowerShell 或 CMD(建议以管理员身份运行)

# 2. 进入项目目录

cd C:\path\to\openclaw

# 3. 创建虚拟环境

python -m venv venv

# 4. 激活虚拟环境

venv\Scripts\activate

# 激活成功后,命令行前面会显示 (venv)

macOS/Linux 系统:

# 1. 打开终端

# 2. 进入项目目录

cd /path/to/openclaw

# 3. 创建虚拟环境

python3 -m venv venv

# 4. 激活虚拟环境

source venv/bin/activate

# 激活成功后,命令行前面会显示 (venv)

取消激活:

deactivate

安装依赖

完整安装步骤:

# 1. 确保虚拟环境已激活

# 命令行前面应该显示 (venv)

# 2. 升级 pip 到最新版本

pip install --upgrade pip

# 3. 安装项目依赖

pip install -r requirements.txt

# 4. 验证安装

pip list

依赖说明:

| 依赖包 | 版本 | 用途 |

|---|---|---|

| requests | 2.31+ | HTTP 请求库 |

| flask | 2.3+ | Web 框架 |

| llama-cpp-python | 0.2+ | 本地模型推理 |

| python-dotenv | 1.0+ | 环境变量管理 |

| websocket-client | 1.6+ | WebSocket 支持 |

安装问题排查:

如果安装失败,尝试以下方法:

# 方法 1:使用国内镜像

pip install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple

# 方法 2:逐个安装

pip install requests flask python-dotenv

# 方法 3:检查 Python 版本

python --version # 确保是 3.8+

🔑 步骤 3:配置 Token

获取 Token 的方法

方法一:Running Hub(推荐)

-

访问官网 - 打开 https://www.runninghub.cn/

-

注册账号 - 点击"注册" - 使用邮箱或手机号注册 - 完成邮箱验证

-

获取 Token - 登录账号 - 进入"个人中心" - 找到"API Token" - 点击"生成 Token" - 复制保存(只显示一次)

-

免费额度 - 注册赠送 1000 点 RH 币 - 每天登录额外赠送 100 点 - 足够个人学习和测试使用

方法二:其他服务商

- 阿里云通义千问:https://dashscope.console.aliyun.com/

- 智谱 AI:https://open.bigmodel.cn/

- 百度文心一言:https://cloud.baidu.com/

配置 Token

详细配置步骤:

- 创建配置文件

在项目根目录创建 .env 文件:

```bash # Linux/Mac touch .env

# Windows(PowerShell) New-Item .env

# Windows(CMD) type nul > .env ```

- 编辑配置文件

用文本编辑器打开 .env,添加以下内容:

```bash # OpenClaw 基础配置 OPENCLAW_PORT=8080 OPENCLAW_HOST=0.0.0.0

# Running Hub Token RUNNING_HUB_TOKEN=your_token_here

# 可选:其他模型服务商 # DASHSCOPE_API_KEY=sk-your-key # ZHIPU_API_KEY=your-key ```

- 保存文件

- 保存并关闭文件

- 确保文件名为

.env(不是.env.txt)

配置说明:

| 参数 | 说明 | 默认值 |

|---|---|---|

| OPENCLAW_PORT | 服务端口 | 8080 |

| OPENCLAW_HOST | 监听地址 | 0.0.0.0 |

| RUNNING_HUB_TOKEN | Running Hub API Token | 必填 |

安全提示:

- ⚠️ Token 相当于密码,不要泄露

- ⚠️ 不要将 .env 文件上传到 GitHub

- ⚠️ 项目已自动将 .env 加入 .gitignore

🚀 步骤 4:启动服务

启动命令

基础启动:

# 1. 确保在项目根目录

cd openclaw

# 2. 确保虚拟环境已激活

# 命令行前面应显示 (venv)

# 3. 启动服务

python3 main.py

# 或

python main.py

查看启动日志:

启动后,你应该看到类似以下的日志:

[INFO] 正在加载配置...

[INFO] 配置文件:.env

[INFO] 正在初始化模型...

[INFO] 模型加载完成

[INFO] 启动 Web 服务器...

✅ OpenClaw started

🔗 Running on http://localhost:8080

📊 状态:就绪

成功标志: - ✅ 看到 "OpenClaw started" - ✅ 看到运行地址 "http://localhost:8080" - ✅ 状态显示"就绪"

启动失败排查:

# 问题 1:端口被占用

# 解决:修改 OPENCLAW_PORT 为其他端口

# 问题 2:找不到模块

# 解决:重新安装依赖 pip install -r requirements.txt

# 问题 3:Token 无效

# 解决:检查.env 文件中的 Token 是否正确

后台运行(可选)

如果需要长期运行,可以使用后台模式:

Linux/Mac:

# 使用 nohup

nohup python3 main.py > openclaw.log 2>&1 &

# 查看日志

tail -f openclaw.log

# 停止服务

pkill -f "python3 main.py"

Windows:

# 使用 Start-Process

Start-Process python -ArgumentList "main.py" -WindowStyle Hidden

# 或使用 nssm 创建 Windows 服务

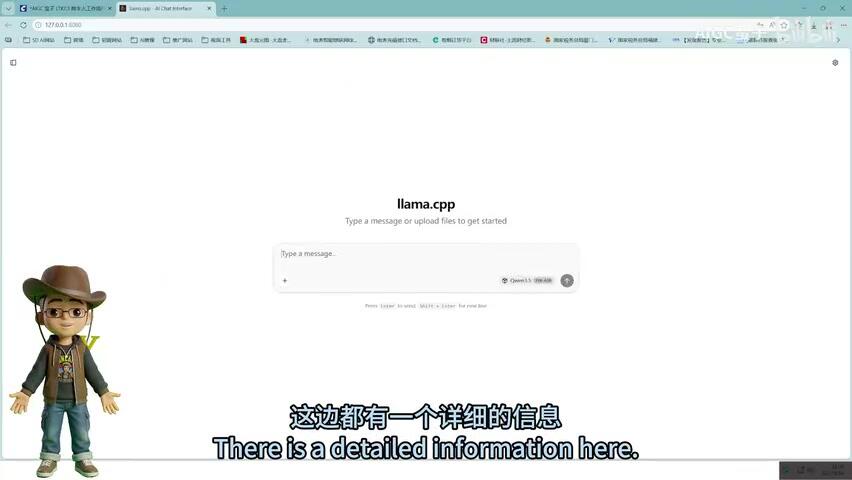

🌐 步骤 5:访问界面

访问管理界面

访问步骤:

-

打开浏览器 - 推荐使用 Chrome、Edge、Firefox

-

输入地址 - 本地访问:http://localhost:8080 - 远程访问:http://你的服务器 IP:8080

-

查看界面 - 应该看到 OpenClaw 管理界面 - 左侧是功能菜单 - 右侧是操作区域

界面功能介绍

主要功能模块:

-

仪表盘(Dashboard) - 显示系统状态 - 查看资源使用情况 - 统计请求数量

-

对话测试(Chat) - 在线测试 AI 对话 - 调整对话参数 - 查看对话历史

-

配置管理(Settings) - 修改系统配置 - 管理 API Token - 配置模型参数

-

日志查看(Logs) - 实时查看运行日志 - 下载日志文件 - 设置日志级别

-

技能管理(Skills) - 启用/禁用技能 - 安装新技能 - 自定义技能

使用技巧: - 💡 首次使用建议先测试对话功能 - 💡 修改配置后需要重启服务 - 💡 定期查看日志排查问题

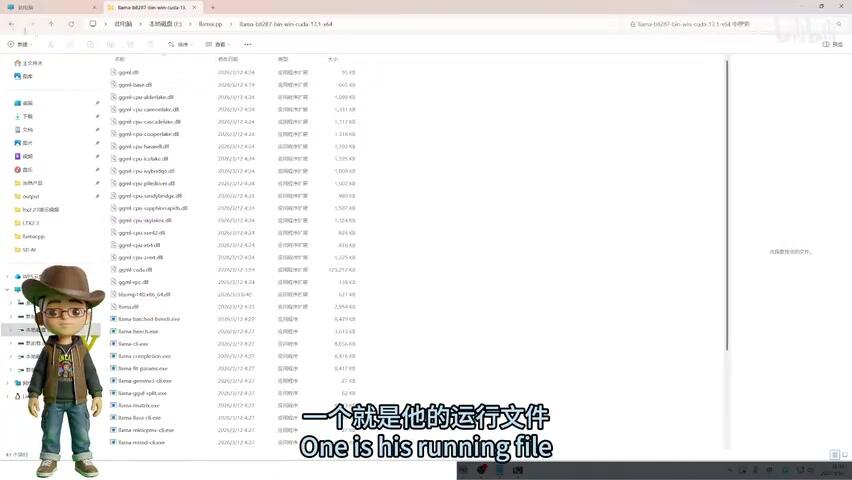

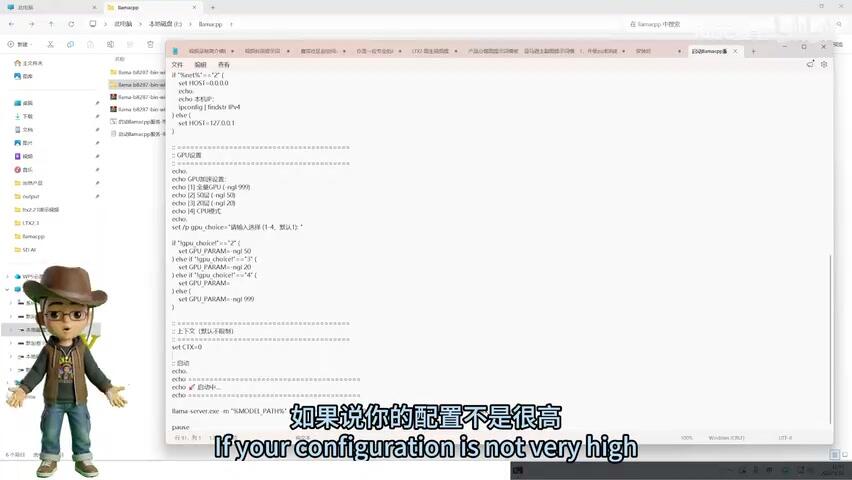

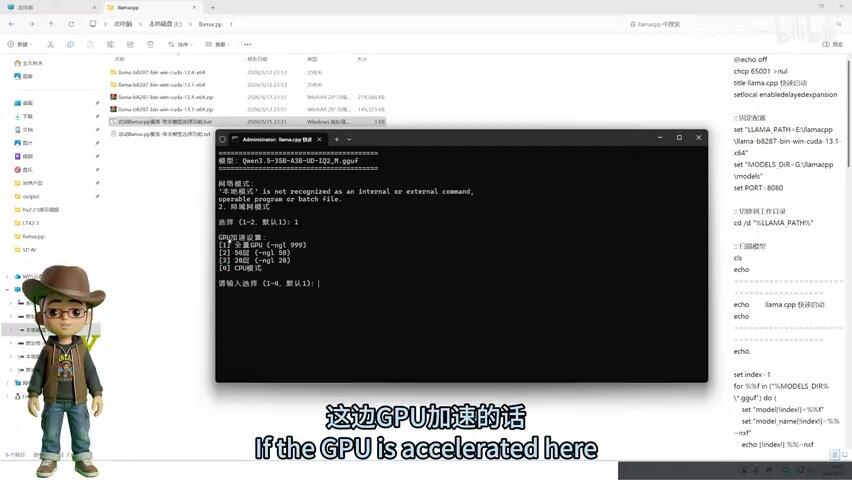

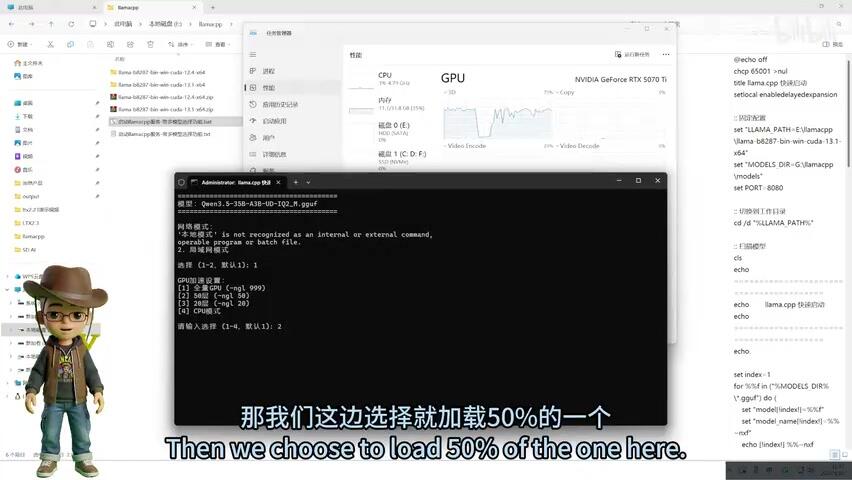

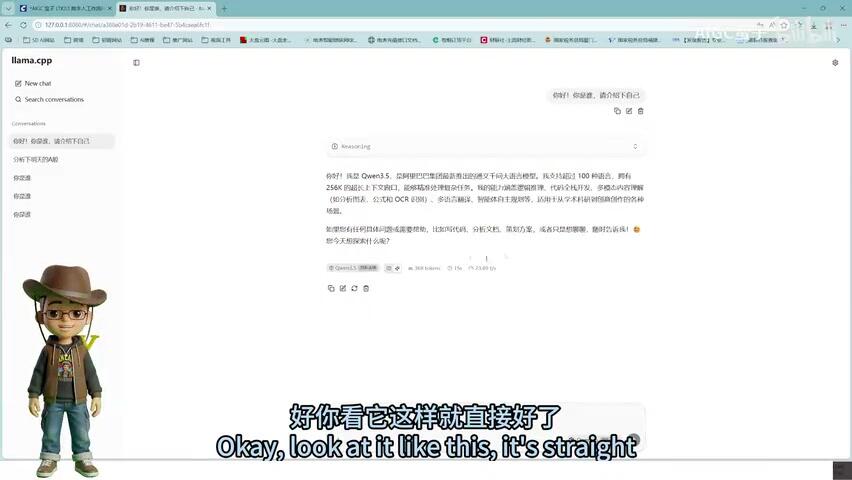

🤖 步骤 6:配置本地模型

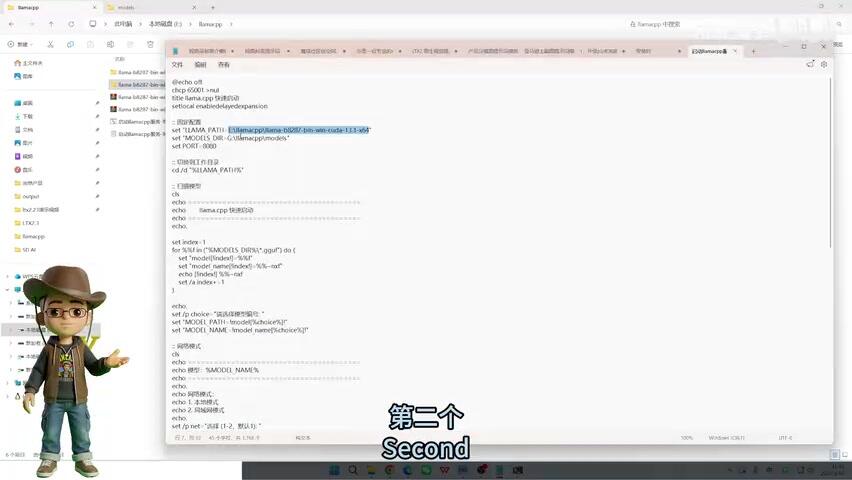

llama.cpp 集成

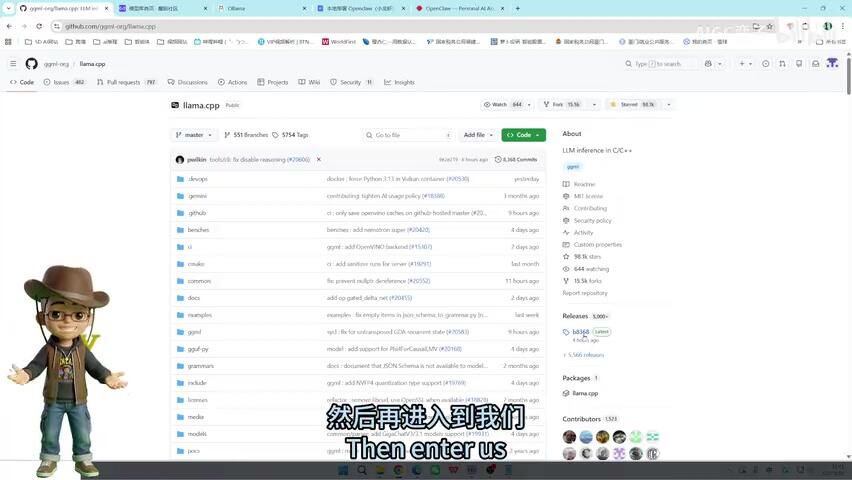

什么是 llama.cpp?

llama.cpp 是一个用 C++ 实现的 llama 模型推理引擎,特点是: - 运行速度快 - 内存占用低 - 支持 CPU 推理 - 无需 GPU 也能运行

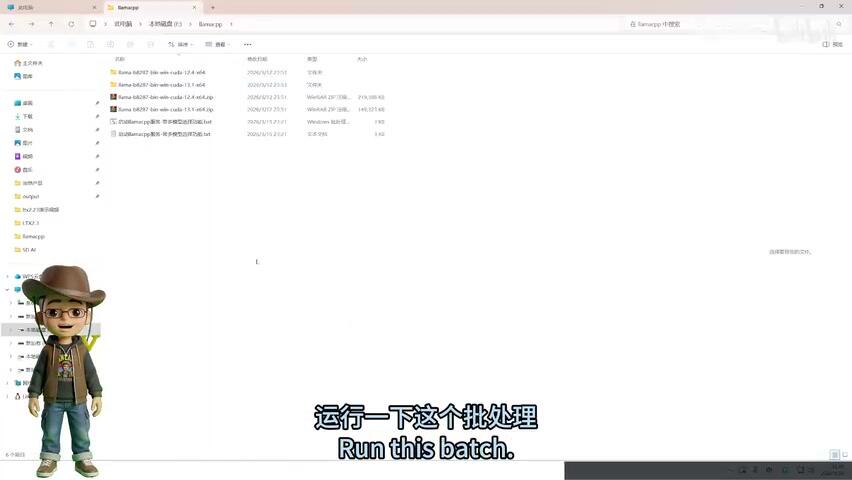

集成步骤:

- 下载 llama.cpp

```bash # 克隆 llama.cpp 项目 git clone https://github.com/ggerganov/llama.cpp.git cd llama.cpp

# 编译(Linux/Mac) make

# Windows 用户下载预编译版本 ```

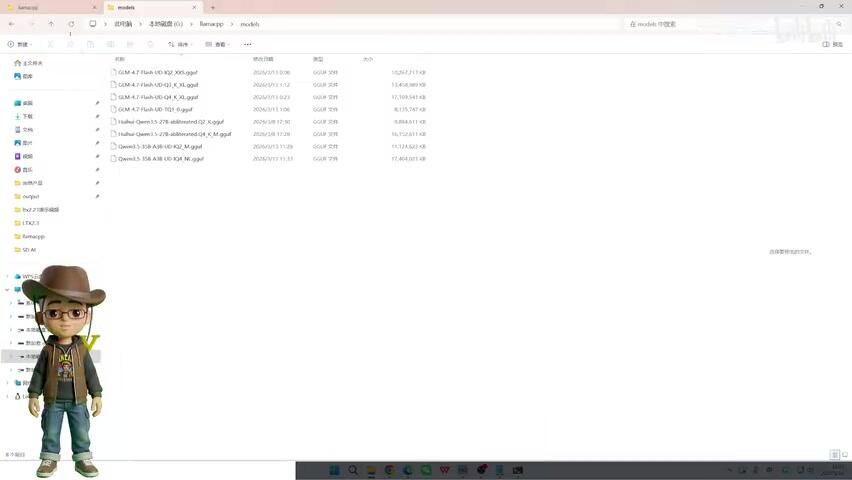

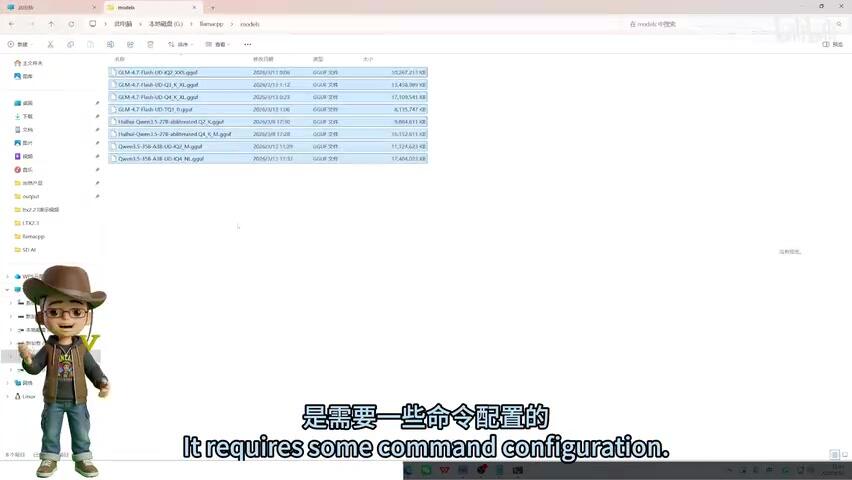

- 下载模型文件

推荐模型: - Qwen-7B-Chat(7B 参数,适合 8GB 内存) - Qwen-14B-Chat(14B 参数,适合 16GB 内存) - Llama-2-7B-Chat(7B 参数,通用性强)

- 配置 OpenClaw

编辑 config/models.py:

python

MODEL_CONFIG = {

'type': 'llama.cpp',

'path': '/path/to/model.gguf',

'n_ctx': 2048, # 上下文长度

'n_threads': 4, # 线程数

}

模型推荐

模型对比:

| 模型 | 参数量 | 内存需求 | 推理速度 | 适用场景 |

|---|---|---|---|---|

| Qwen-7B | 7B | 8GB | 快 | 日常对话、文本生成 |

| Qwen-14B | 14B | 16GB | 中等 | 复杂任务、代码生成 |

| Llama-2-7B | 7B | 8GB | 快 | 英文任务、通用对话 |

| ChatGLM3-6B | 6B | 6GB | 很快 | 中文对话、轻量应用 |

选择建议: - 初学者:从 Qwen-7B 开始 - 中文场景:优先 Qwen 系列 - 英文场景:考虑 Llama-2 - 内存有限:选择 6B-7B 模型

✅ 步骤 7:测试对话

基础对话测试

测试步骤:

-

打开对话界面 - 访问 http://localhost:8080/chat

-

发送测试消息

``` 用户:你好 AI: 你好!有什么可以帮你的吗?

用户:今天天气怎么样 AI: 我可以帮你查询天气信息,请告诉我你所在的城市。

用户:讲个笑话 AI: 为什么程序员总是分不清节日?因为 Oct 31 == Dec 25! ```

- 检查回复质量 - 回复是否合理 - 响应速度是否正常 - 上下文理解是否准确

功能验证清单

必须验证的功能:

- ✅ 文本对话:发送消息,检查回复

- ✅ 响应速度:应在 3 秒内回复

- ✅ 上下文理解:多轮对话是否连贯

- ✅ Token 使用:查看 Token 消耗情况

- ✅ 错误处理:发送无效输入,检查错误提示

性能指标:

| 指标 | 正常范围 | 说明 |

|---|---|---|

| 响应时间 | <3 秒 | 从发送到收到回复 |

| Token 消耗 | 合理 | 与回复长度匹配 |

| 并发支持 | 10+ | 同时处理多个请求 |

| 内存占用 | <2GB | 运行时内存使用 |

💡 常见问题

Q1: Token 不够用怎么办?

解决方案:

-

使用本地模型 - 完全不需要 Token - 一次性投入,长期使用 - 数据完全本地化

-

优化 Token 使用 - 减少上下文长度 - 使用更高效的提示词 - 避免重复请求

-

选择免费额度多的服务商 - Running Hub:注册送 1000 点 - 每天登录送 100 点 - 多个服务商轮换使用

Q2: 本地模型运行太慢?

优化建议:

-

使用量化模型

bash # 下载 4bit 或 8bit 量化版本 # 文件大小减少 50-75% # 推理速度提升 2-3 倍 -

减少上下文长度

python # 在配置文件中 n_ctx = 1024 # 从 2048 减少到 1024 -

调整线程数

python n_threads = 8 # 根据 CPU 核心数调整 -

升级硬件 - 增加内存 - 使用更快的 CPU - 考虑 GPU 加速

Q3: 启动时报错怎么办?

常见错误及解决:

# 错误 1:ModuleNotFoundError

# 解决:pip install -r requirements.txt

# 错误 2:Port already in use

# 解决:修改 OPENCLAW_PORT 或停止占用端口的程序

# 错误 3:Invalid Token

# 解决:检查.env 文件中的 Token 是否正确

# 错误 4:Model not found

# 解决:检查模型路径配置

Q4: 如何接入微信平台?

接入步骤:

- 注册微信公众号

- 获取 AppID 和 AppSecret

- 配置服务器地址

- 在 OpenClaw 中启用微信技能

- 测试消息收发

详细教程关注公众号后续文章!

🎉 总结

恭喜你完成了 OpenClaw 本地模型的完整搭建!

你现在可以:

- ✅ 自由使用 Token:不再担心额度限制

- ✅ 本地运行 AI 模型:完全掌控数据

- ✅ 多平台接入:微信、飞书、钉钉

- ✅ 自定义扩展:开发自己的技能

- ✅ 零成本使用:完全免费开源

核心要点回顾:

- 环境准备:Python 3.8+、4GB 内存、10GB 磁盘

- 获取项目:网盘下载或 Git 克隆

- 配置环境:虚拟环境 + 安装依赖

- 配置 Token:Running Hub 或其他服务商

- 启动服务:python3 main.py

- 访问界面:http://localhost:8080

- 配置模型:llama.cpp 集成

- 测试对话:验证功能正常

📢 关于作者

本文首发于 Geek 运维,专注于分享最新 AI 技术资讯、实用技术教程和运维开发最佳实践。

欢迎关注交流: - 🌐 博客:https://www.3800ai.com - 📱 微信公众号:Geek 运维 - 💬 技术交流群:关注公众号获取入群方式

📚 相关文章推荐

你可能还想看:

评论区