OpenClaw对话式部署:10分钟搭建私人AI助手

Claude Code全自动化 + 一键安装脚本,15个顶流模型,20+专业工具

写在前面

你是否想过拥有一个属于自己的 AI 助手?不用担心 API 限制,不用切换多个平台,一个 Telegram Bot 就能调用 GPT-5.2、Claude Opus 4.5、DeepSeek V3.2 等 15 个顶流模型?

本文将手把手教你,通过 一键安装脚本 或 Claude Code 对话式部署,10 分钟内在 VPS 上搭建一个功能完整的 AI 助手平台。

你将获得:

• 15 个顶流 AI 模型(GPT、Claude、Gemini、DeepSeek 等) • 20+ 专业工具(GitHub CLI、FFmpeg、Whisper、浏览器自动化) • 一键安装脚本(无需手动配置) • 对话式部署(Claude Code 全自动化) • Telegram Bot 交互界面 • 自动故障转移 • 开箱即用

目录

• 项目简介 • 部署架构 • 准备工作 • 自动化部署流程 • 配置说明 • 完整配置模板 • 功能验证 • 常见问题 • 进阶配置 • 性能优化 • 安全建议 • 监控和维护 • 总结

项目简介

什么是 OpenClaw?

OpenClaw 是一个开源的个人 AI 助手平台,支持:

• 多个顶级 AI 模型(GPT、Claude、Gemini、DeepSeek 等) • 多通道接入(Telegram、Discord、Slack、WhatsApp 等) • 丰富的工具集成(GitHub、浏览器、媒体处理等) • 高度可定制化

部署目标

本教程将帮助你:

1. 在 VPS 服务器上部署 OpenClaw 2. 配置 Telegram Bot 作为交互界面 3. 接入中国 API 代理服务(云雾 AI) 4. 配置 15 个顶流 AI 模型 5. 安装 20+ 实用工具和技能包

部署后效果

完成部署后,你将拥有:

• 15 个顶流模型:GPT-5.2、Claude Opus 4.5、DeepSeek V3.2、Gemini 3 Pro 等 • 20+ 专业工具:GitHub CLI、FFmpeg、Whisper、浏览器自动化等 • Telegram Bot 界面:随时随地与 AI 对话 • 自动故障转移:主模型不可用时自动切换备用模型 • 开箱即用:安装完成即可使用,无需额外配置

适合人群

• 想要拥有私人 AI 助手的开发者 • 需要频繁使用多个 AI 模型的用户 • 希望自动化工作流程的技术爱好者 • 对 AI 工具集成感兴趣的学习者

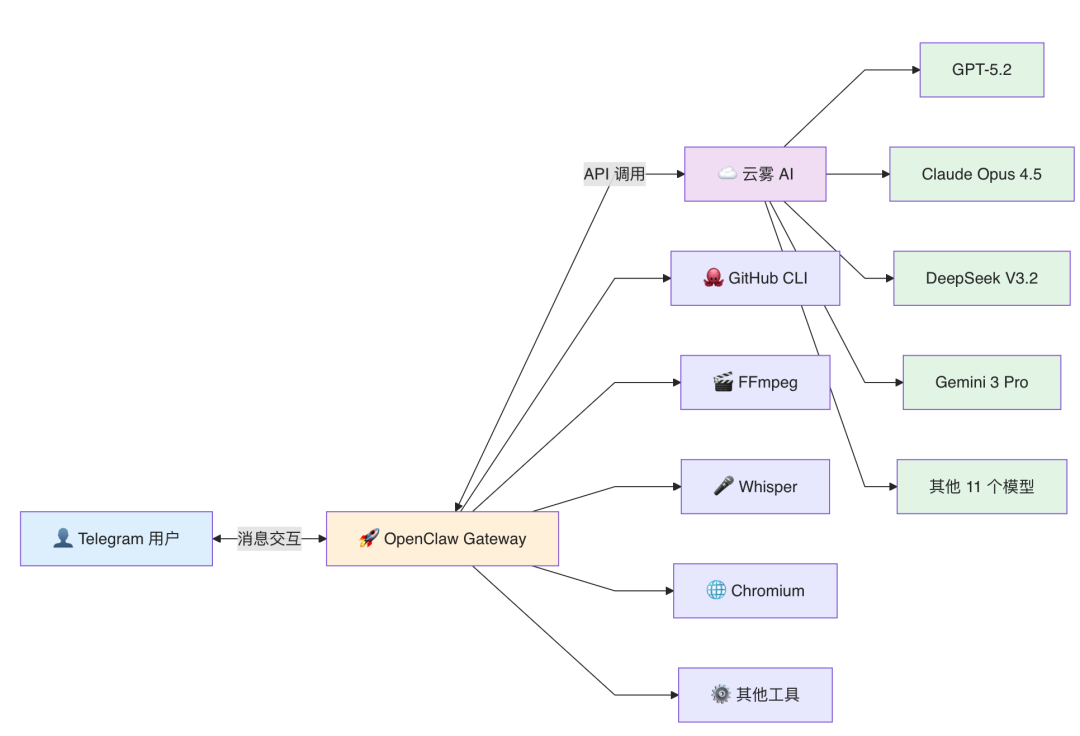

部署架构

架构说明:

数据流向:

1. 用户通过 Telegram 发送消息 2. OpenClaw Gateway 接收并处理请求 3. 根据需要调用 AI 模型或工具 4. 返回处理结果给用户

↕

┌─────────────────┐

│ Telegram Bot │

│ @your_bot │

└─────────────────┘

↕

┌─────────────────┐

│ 用户手机/电脑 │

└─────────────────┘

准备工作

1. 服务器要求

• 操作系统: Ubuntu 22.04 LTS(推荐) • 配置: 最低 2 核 2GB 内存 • 网络: 能访问国际网络(用于安装依赖) • 权限: root 或 sudo 权限

2. 必需的账号和密钥

2.1 Telegram Bot Token

1. 在 Telegram 中搜索 @BotFather2. 发送 /newbot创建新机器人3. 按提示设置名称和用户名 4. 获得 Bot Token(格式: 123456789:ABCdefGHIjklMNOpqrsTUVwxyz)

2.2 AI API 密钥

选项 A:使用中国 API 代理(推荐)

• 服务商:云雾 AI (https://yunwu.ai/register?aff=PBpy) • 优势:一个 API Key 访问所有模型,价格便宜 • 注册后获得 API Key(格式: sk-xxxxx)

选项 B:使用官方 API

• OpenAI: https://platform.openai.com • Anthropic: https://console.anthropic.com • Google: https://ai.google.dev

3. SSH 访问

确保你能通过 SSH 连接到服务器:

ssh root@your-server-ip

自动化部署流程

方式一:一键安装脚本(推荐)

适合场景:快速部署,零配置,开箱即用

特点:

• ✅ 一条命令完成所有安装 • ✅ 自动配置 15 个模型 • ✅ 自动安装 20+ 工具 • ✅ 交互式引导,无需技术背景

下载并运行一键安装脚本:

# 下载脚本

wget https://raw.githubusercontent.com/taielab/openclaw-autopilot/main/install-openclaw.sh

# 赋予执行权限

chmod +x install-openclaw.sh

# 运行安装

./install-openclaw.sh

脚本会交互式提示你输入:

1. Telegram Bot Token 2. API 密钥 3. API 服务商选择

整个过程约 5-10 分钟,完全自动化。

方式二:使用 Claude Code 对话式部署(推荐)

适合场景:想要了解部署过程,需要定制化配置

特点:

• ✅ 对话式交互,自然语言控制 • ✅ 全程自动化,无需手动操作 • ✅ 可定制配置,灵活调整 • ✅ 学习部署过程,掌握原理

本教程的核心方法,通过与 Claude Code 对话完成全自动部署。

步骤 1:准备信息

准备以下信息:

• 服务器 IP 地址 • SSH 用户名和密码 • Telegram Bot Token • API 密钥和服务商

步骤 2:开始对话

向 Claude Code 发送:

我想在 VPS 服务器上部署 OpenClaw AI 助手:

- 服务器:<IP地址>

- 用户:root

- 密码:<密码>

- Telegram Bot Token:<token>

- API:云雾 AI,Key:<api-key>

请帮我完成全自动部署。

步骤 3:自动化执行

Claude Code 会自动:

1. 连接服务器 2. 检查系统环境 3. 安装 Node.js 4. 安装 OpenClaw 5. 配置服务 6. 安装工具和依赖 7. 启动服务 8. 验证部署

整个过程约 10-15 分钟。

配置说明

核心配置文件

OpenClaw 的主配置文件位于:~/.openclaw/openclaw.json

基础配置结构

{

"agents":{

"defaults":{

"workspace":"~/.openclaw/workspace",

"models":{

"provider/model-id":{"alias":"显示名称"}

},

"model":{

"primary":"provider/model-id",

"fallbacks":["backup-model-1","backup-model-2"]

}

}

},

"auth":{

"profiles":{

"provider:default":{

"provider":"provider-name",

"mode":"api_key"

}

}

},

"models":{

"mode":"merge",

"providers":{

"provider-name":{

"baseUrl":"https://api.example.com",

"api":"openai-completions",

"models":[

{

"id":"model-id",

"name":"Model Name",

"contextWindow":128000,

"maxTokens":8192

}

]

}

}

},

"browser":{

"enabled":true,

"executablePath":"/usr/bin/chromium-browser",

"headless":true

},

"channels":{

"telegram":{

"botToken":"YOUR_BOT_TOKEN",

"allowFrom":["*"],

"dmPolicy":"open"

}

},

"gateway":{

"mode":"local",

"bind":"loopback",

"port":18789,

"auth":{

"mode":"token",

"token":"GENERATED_TOKEN"

}

}

}

模型配置示例

配置云雾 AI 多模型

{

"models":{

"mode":"merge",

"providers":{

"yunwu-gpt":{

"baseUrl":"https://yunwu.ai/v1",

"api":"openai-completions",

"models":[

{"id":"gpt-5.2","name":"GPT-5.2","contextWindow":200000,"maxTokens":16384},

{"id":"gpt-5.2-codex","name":"GPT-5.2 Codex","contextWindow":200000,"maxTokens":16384}

]

},

"yunwu-claude":{

"baseUrl":"https://yunwu.ai",

"api":"anthropic-messages",

"models":[

{"id":"claude-opus-4-5-20251101","name":"Claude Opus 4.5","contextWindow":200000,"maxTokens":8192}

]

},

"yunwu-deepseek":{

"baseUrl":"https://yunwu.ai/v1",

"api":"openai-completions",

"models":[

{"id":"deepseek-v3.2","name":"DeepSeek V3.2","contextWindow":64000,"maxTokens":8192}

]

}

}

}

}

鉴权配置

鉴权文件位于:~/.openclaw/agents/main/agent/auth-profiles.json

{

"version":1,

"profiles":{

"yunwu-gpt:default":{

"type":"api_key",

"provider":"yunwu-gpt",

"key":"sk-your-api-key-here"

},

"yunwu-claude:default":{

"type":"api_key",

"provider":"yunwu-claude",

"key":"sk-your-api-key-here"

}

},

"lastGood":{

"yunwu-gpt":"yunwu-gpt:default",

"yunwu-claude":"yunwu-claude:default"

}

}

Systemd 服务配置

服务文件位于:~/.config/systemd/user/openclaw-gateway.service

[Unit]

Description=OpenClaw Gateway (v2026.1.29)

After=network.target

[Service]

Type=simple

ExecStart=/usr/local/bin/openclaw gateway --port 18789

Restart=always

RestartSec=10

[Install]

WantedBy=default.target

功能验证

1. 检查服务状态

# 查看服务状态

systemctl --user status openclaw-gateway

# 查看端口监听

ss -tlnp | grep 18789

# 查看日志

journalctl --user -u openclaw-gateway -f

2. 测试 Telegram Bot

1. 在 Telegram 中搜索你的 Bot 2. 发送 /start或任意消息3. Bot 应该会回复

3. 测试模型切换

在 Telegram 中发送:

/model

应该显示所有可用模型列表。

4. 测试工具调用

帮我查看 GitHub 上的热门项目

Bot 应该能调用 GitHub CLI 工具。

常见问题

Q1: 服务启动失败

检查配置文件

openclaw doctor

查看详细错误

openclaw gateway --port 18789

Q2: Telegram Bot 无响应

检查 Bot Token

# 测试 Token 是否有效

curl https://api.telegram.org/bot<YOUR_TOKEN>/getMe

检查网络连接

# 确保服务器能访问 Telegram API

curl https://api.telegram.org

Q3: API 调用失败

测试 API 连接

curl -X POST https://yunwu.ai/v1/chat/completions \

-H "Authorization: Bearer sk-your-key" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-5.2",

"messages": [{"role": "user", "content": "Hello"}]

}'

Q4: 模型列表为空

检查鉴权文件

cat ~/.openclaw/agents/main/agent/auth-profiles.json

确保 API Key 正确配置。

Q5: 技能无法使用

检查依赖工具

# 查看技能状态

openclaw skills list

# 查看特定技能

openclaw skills info github

安装缺失的工具:

# GitHub CLI

apt-get install gh

# FFmpeg

apt-get install ffmpeg

# Whisper

pip3 install openai-whisper

进阶配置

1. 添加更多模型

编辑 ~/.openclaw/openclaw.json,在 models.providers 中添加:

{

"your-provider":{

"baseUrl":"https://api.example.com",

"api":"openai-completions",

"models":[

{"id":"model-id","name":"Model Name","contextWindow":128000,"maxTokens":8192}

]

}

}

2. 配置浏览器自动化

{

"browser":{

"enabled":true,

"executablePath":"/usr/bin/chromium-browser",

"headless":true

}

}

3. 添加更多通道

Discord

{

"channels":{

"discord":{

"token":"YOUR_DISCORD_BOT_TOKEN"

}

}

}

Slack

{

"channels":{

"slack":{

"botToken":"xoxb-your-token",

"appToken":"xapp-your-token"

}

}

}

4. 配置定时任务

{

"cron":{

"enabled":true

}

}

5. 自定义工作空间

创建 ~/.openclaw/workspace/AGENTS.md:

# AI 助手配置

你是一个专业的 AI 助手,擅长:

- 代码开发和调试

- 数据分析

- 内容创作

- 问题解决

## 工作原则

- 准确、高效、友好

- 主动思考和建议

- 使用合适的工具

6. 安装更多技能

# 查看所有技能

openclaw skills list

# 查看技能详情

openclaw skills info <skill-name>

# 安装技能依赖

# 根据技能要求安装对应的 CLI 工具

性能优化

1. 调整并发限制

{

"gateway":{

"maxConcurrentRequests":10

}

}

2. 配置缓存

{

"cache":{

"enabled":true,

"ttl":3600

}

}

3. 日志级别

# 生产环境使用 info 级别

export LOG_LEVEL=info

# 调试时使用 debug 级别

export LOG_LEVEL=debug

安全建议

1. 限制访问

{

"channels":{

"telegram":{

"allowFrom":["123456789"],// 只允许特定用户

"dmPolicy":"pairing"// 需要配对

}

}

}

2. 使用防火墙

# 只允许本地访问 Gateway

ufw allow from 127.0.0.1 to any port 18789

3. 定期更新

# 更新 OpenClaw

npm update -g openclaw

# 更新系统

apt-get update && apt-get upgrade

4. 备份配置

# 备份配置文件

tar -czf openclaw-backup-$(date +%Y%m%d).tar.gz ~/.openclaw

监控和维护

1. 服务监控

# 查看服务状态

systemctl --user status openclaw-gateway

# 查看资源使用

htop

# 查看日志

journalctl --user -u openclaw-gateway -f

2. 自动重启

Systemd 服务已配置自动重启:

Restart=always

RestartSec=10

3. 日志轮转

创建 /etc/logrotate.d/openclaw:

/var/log/openclaw/*.log {

daily

rotate 7

compress

delaycompress

missingok

notifempty

}

完整配置模板

基础信息模板

# 服务器信息

服务器IP:your-server-ip

SSH用户:root

SSH密码:your-password

# Telegram Bot

Bot Token:123456789:ABCdefGHIjklMNOpqrsTUVwxyz

Bot用户名:@your_bot

# API 配置(云雾 AI)

API地址:https://yunwu.ai

API Key:sk-xxxxxxxxxxxxxxxxxxxxx

支持模型:GPT-5.2,ClaudeOpus4.5,DeepSeekV3.2,Gemini3Pro,GLM-4.7,Qwen3Max,Grok4.1

完整配置文件:~/.openclaw/openclaw.json

{

"agents":{

"defaults":{

"workspace":"~/.openclaw/workspace",

"models":{

"api-proxy-gpt/gpt-5.2":{"alias":"GPT-5.2"},

"api-proxy-gpt/gpt-5.2-codex":{"alias":"GPT-5.2 Codex"},

"api-proxy-claude/claude-opus-4-5-20251101":{"alias":"Claude Opus 4.5"},

"api-proxy-claude/claude-opus-4-5-20251101-thinking":{"alias":"Claude Opus 4.5 Thinking"},

"api-proxy-claude/claude-sonnet-4-5-20250929":{"alias":"Claude Sonnet 4.5"},

"api-proxy-claude/claude-sonnet-4-5-20250929-thinking":{"alias":"Claude Sonnet 4.5 Thinking"},

"api-proxy-deepseek/deepseek-v3.2":{"alias":"DeepSeek V3.2"},

"api-proxy-deepseek/deepseek-v3.2-thinking":{"alias":"DeepSeek V3.2 Thinking"},

"api-proxy-google/gemini-3-pro-preview":{"alias":"Gemini 3 Pro"},

"api-proxy-google/gemini-3-pro-image-preview":{"alias":"Gemini 3 Pro Image"},

"api-proxy-glm/glm-4.7":{"alias":"GLM-4.7"},

"api-proxy-glm/glm-4.7-thinking":{"alias":"GLM-4.7 Thinking"},

"api-proxy-minimax/minimax-m2.1":{"alias":"MiniMax M2.1"},

"api-proxy-qwen/qwen3-max-2026-01-23":{"alias":"Qwen3 Max"},

"api-proxy-xai/grok-4.1":{"alias":"Grok 4.1"}

},

"model":{

"primary":"api-proxy-gpt/gpt-5.2",

"fallbacks":[

"api-proxy-claude/claude-opus-4-5-20251101",

"api-proxy-deepseek/deepseek-v3.2"

]

}

}

},

"auth":{

"profiles":{

"api-proxy-gpt:default":{"provider":"api-proxy-gpt","mode":"api_key"},

"api-proxy-claude:default":{"provider":"api-proxy-claude","mode":"api_key"},

"api-proxy-deepseek:default":{"provider":"api-proxy-deepseek","mode":"api_key"},

"api-proxy-google:default":{"provider":"api-proxy-google","mode":"api_key"},

"api-proxy-glm:default":{"provider":"api-proxy-glm","mode":"api_key"},

"api-proxy-minimax:default":{"provider":"api-proxy-minimax","mode":"api_key"},

"api-proxy-qwen:default":{"provider":"api-proxy-qwen","mode":"api_key"},

"api-proxy-xai:default":{"provider":"api-proxy-xai","mode":"api_key"}

}

},

"models":{

"mode":"merge",

"providers":{

"api-proxy-gpt":{

"baseUrl":"https://yunwu.ai/v1",

"api":"openai-completions",

"models":[

{"id":"gpt-5.2","name":"GPT-5.2","contextWindow":200000,"maxTokens":16384},

{"id":"gpt-5.2-codex","name":"GPT-5.2 Codex","contextWindow":200000,"maxTokens":16384}

]

},

"api-proxy-claude":{

"baseUrl":"https://yunwu.ai",

"api":"anthropic-messages",

"models":[

{"id":"claude-opus-4-5-20251101","name":"Claude Opus 4.5","contextWindow":200000,"maxTokens":8192},

{"id":"claude-opus-4-5-20251101-thinking","name":"Claude Opus 4.5 Thinking","contextWindow":200000,"maxTokens":8192},

{"id":"claude-sonnet-4-5-20250929","name":"Claude Sonnet 4.5","contextWindow":200000,"maxTokens":8192},

{"id":"claude-sonnet-4-5-20250929-thinking","name":"Claude Sonnet 4.5 Thinking","contextWindow":200000,"maxTokens":8192}

]

},

"api-proxy-deepseek":{

"baseUrl":"https://yunwu.ai/v1",

"api":"openai-completions",

"models":[

{"id":"deepseek-v3.2","name":"DeepSeek V3.2","contextWindow":64000,"maxTokens":8192},

{"id":"deepseek-v3.2-thinking","name":"DeepSeek V3.2 Thinking","contextWindow":64000,"maxTokens":8192}

]

},

"api-proxy-google":{

"baseUrl":"https://yunwu.ai",

"api":"google-generative-ai",

"models":[

{"id":"gemini-3-pro-preview","name":"Gemini 3 Pro","contextWindow":2000000,"maxTokens":8192},

{"id":"gemini-3-pro-image-preview","name":"Gemini 3 Pro Image","contextWindow":2000000,"maxTokens":8192}

]

},

"api-proxy-glm":{

"baseUrl":"https://yunwu.ai/v1",

"api":"openai-completions",

"models":[

{"id":"glm-4.7","name":"GLM-4.7","contextWindow":128000,"maxTokens":8192},

{"id":"glm-4.7-thinking","name":"GLM-4.7 Thinking","contextWindow":128000,"maxTokens":8192}

]

},

"api-proxy-minimax":{

"baseUrl":"https://yunwu.ai/v1",

"api":"openai-completions",

"models":[

{"id":"minimax-m2.1","name":"MiniMax M2.1","contextWindow":128000,"maxTokens":8192}

]

},

"api-proxy-qwen":{

"baseUrl":"https://yunwu.ai/v1",

"api":"openai-completions",

"models":[

{"id":"qwen3-max-2026-01-23","name":"Qwen3 Max","contextWindow":128000,"maxTokens":8192}

]

},

"api-proxy-xai":{

"baseUrl":"https://yunwu.ai/v1",

"api":"openai-completions",

"models":[

{"id":"grok-4.1","name":"Grok 4.1","contextWindow":128000,"maxTokens":8192}

]

}

}

},

"browser":{

"enabled":true,

"executablePath":"/usr/bin/chromium-browser",

"headless":true

},

"channels":{

"telegram":{

"botToken":"YOUR_TELEGRAM_BOT_TOKEN",

"allowFrom":["*"],

"dmPolicy":"open"

}

},

"gateway":{

"mode":"local",

"bind":"loopback",

"port":18789,

"auth":{

"mode":"token",

"token":"GENERATED_AUTH_TOKEN"

}

}

}

鉴权文件:~/.openclaw/agents/main/agent/auth-profiles.json

{

"version":1,

"profiles":{

"api-proxy-gpt:default":{

"type":"api_key",

"provider":"api-proxy-gpt",

"key":"YOUR_API_KEY"

},

"api-proxy-claude:default":{

"type":"api_key",

"provider":"api-proxy-claude",

"key":"YOUR_API_KEY"

},

"api-proxy-deepseek:default":{

"type":"api_key",

"provider":"api-proxy-deepseek",

"key":"YOUR_API_KEY"

},

"api-proxy-google:default":{

"type":"api_key",

"provider":"api-proxy-google",

"key":"YOUR_API_KEY"

},

"api-proxy-glm:default":{

"type":"api_key",

"provider":"api-proxy-glm",

"key":"YOUR_API_KEY"

},

"api-proxy-minimax:default":{

"type":"api_key",

"provider":"api-proxy-minimax",

"key":"YOUR_API_KEY"

},

"api-proxy-qwen:default":{

"type":"api_key",

"provider":"api-proxy-qwen",

"key":"YOUR_API_KEY"

},

"api-proxy-xai:default":{

"type":"api_key",

"provider":"api-proxy-xai",

"key":"YOUR_API_KEY"

}

},

"lastGood":{

"api-proxy-gpt":"api-proxy-gpt:default",

"api-proxy-claude":"api-proxy-claude:default",

"api-proxy-deepseek":"api-proxy-deepseek:default",

"api-proxy-google":"api-proxy-google:default",

"api-proxy-glm":"api-proxy-glm:default",

"api-proxy-minimax":"api-proxy-minimax:default",

"api-proxy-qwen":"api-proxy-qwen:default",

"api-proxy-xai":"api-proxy-xai:default"

}

}

环境变量配置(可选)

如果不想在配置文件中硬编码 API Key,可以使用环境变量:

编辑 ~/.profile 或 ~/.bashrc:

# OpenClaw API Keys

export OPENAI_API_KEY="sk-xxxxxxxxxxxxxxxxxxxxx"

export ANTHROPIC_API_KEY="sk-ant-xxxxxxxxxxxxxxxxxxxxx"

# 云雾 AI(所有模型共用一个 Key)

export YUNWU_API_KEY="sk-xxxxxxxxxxxxxxxxxxxxx"

快速配置命令

# 生成认证 Token

openssl rand -hex 32

# 设置文件权限

chmod 700 ~/.openclaw

chmod 600 ~/.openclaw/openclaw.json

chmod 600 ~/.openclaw/agents/main/agent/auth-profiles.json

# 验证配置

openclaw doctor

# 测试 API 连接

curl -X POST https://yunwu.ai/v1/chat/completions \

-H "Authorization: Bearer YOUR_API_KEY" \

-H "Content-Type: application/json" \

-d '{"model":"gpt-5.2","messages":[{"role":"user","content":"test"}]}'

# 测试 Telegram Bot

curl https://api.telegram.org/botYOUR_BOT_TOKEN/getMe

配置检查清单

• [ ] Telegram Bot Token 已配置 • [ ] API Key 已配置 • [ ] 模型列表已配置 • [ ] 鉴权文件已创建 • [ ] 文件权限已设置 • [ ] Systemd 服务已启用 • [ ] Gateway 端口正常监听 • [ ] Telegram Bot 能正常响应

推荐技能和扩展

OpenClaw 支持丰富的技能扩展,以下是社区推荐的优质技能:

国内通道集成

• 飞书集成: clawdbot-feishu

https://github.com/m1heng/clawdbot-feishu• 微信集成: OpenClaw-Wechat

https://github.com/dingxiang-me/OpenClaw-Wechat• 钉钉集成: dingtalk-moltbot-connector

https://github.com/DingTalk-Real-AI/dingtalk-moltbot-connector• 国内优化: moltbot-china

https://github.com/BytePioneer-AI/moltbot-china

技能市场

• Awesome Skills: awesome-openclaw-skills

https://github.com/VoltAgent/awesome-openclaw-skills

💡 提示:安装技能后可大幅扩展 AI 助手的能力,支持更多场景和工作流。

总结

通过本教程,你已经掌握了:

1. 使用 Claude Code 对话式自动部署 OpenClaw 2. 配置 15 个顶流 AI 模型 3. 接入 Telegram Bot 4. 安装实用工具和技能 5. 进行性能优化和安全加固

现在,你拥有了一个功能强大的私人 AI 助手平台,可以:

• 随时切换 15 个顶流模型 • 使用 20+ 专业工具处理各种任务 • 通过 Telegram 随时随地访问 • 自动故障转移,稳定可靠

评论区